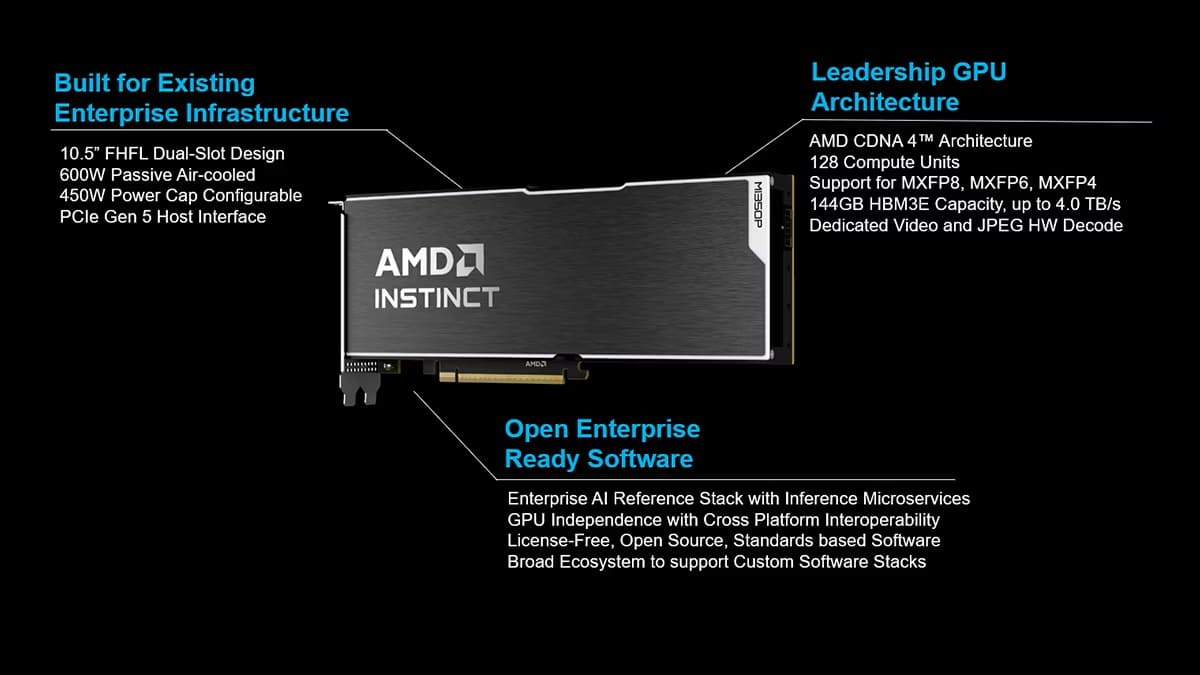

AMD Instinct MI350P amplía la familia de aceleradores de la compañía con una propuesta muy concreta: llevar la arquitectura CDNA 4 a servidores estándar mediante una tarjeta PCIe de doble slot, pensada para cargas de inferencia de IA empresarial sin obligar a desplegar infraestructura especializada desde cero. La idea pasa por ofrecer una vía directa para ampliar capacidad de cómputo dentro de centros de datos ya existentes.

La nueva tarjeta toma como base el silicio de la Instinct MI350X, aunque lo reduce a una configuración más contenida para adaptarse al formato PCIe. A cambio, mantiene cifras muy agresivas para su segmento, con 144 GB de memoria HBM3E y hasta 4 TB/s de ancho de banda, un consumo configurable entre 450W y 600W, además de soporte nativo para formatos de baja precisión MXFP4 y MXFP6.

Un acelerador PCIe para servidores ya desplegados

La Instinct MI350P busca cubrir un espacio especialmente importante dentro de la adopción de IA: empresas que necesitan más rendimiento para inferencia local dentro de su propio centro de datos, pero no quieren asumir el coste de una plataforma completa basada en racks propietarios o sistemas de refrigeración más complejos. El formato PCIe de doble slot permite instalar la tarjeta en servidores de aire convencionales, siempre que exista margen eléctrico, térmico y físico.

Ese planteamiento encaja con el crecimiento de la IA agéntica, donde muchos despliegues no solo necesitan entrenar modelos, sino ejecutar inferencia de forma continua dentro de la propia infraestructura. Para AMD, la MI350P actúa como una pieza intermedia entre aceleradores de máximo rendimiento y soluciones más accesibles para empresas con servidores compatibles ya instalados.

La tarjeta utiliza un diseño pasivo orientado a servidores, mide 267 mm de longitud y recurre a un conector de 16 pines para alimentar un TBP máximo de 600W. La posibilidad de configurarla a 450W también pesa en entornos donde la densidad por rack, el margen de refrigeración o el consumo total condicionan cualquier actualización de hardware.

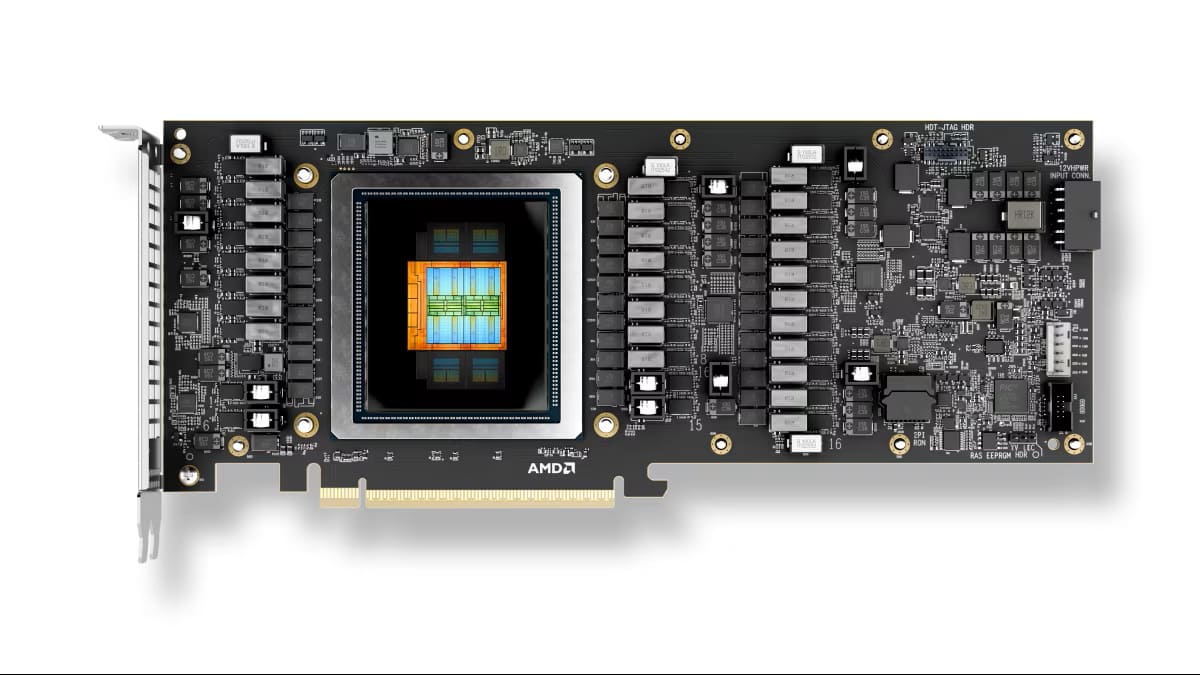

CDNA 4, 128 unidades de cómputo y memoria HBM3E de alto ancho de banda

A nivel técnico, la AMD Instinct MI350P se basa en la arquitectura CDNA 4 y emplea un diseño con 4 XCD fabricados bajo el proceso de 3 nm de TSMC. La configuración queda por debajo de la MI350X, pero mantiene un bloque de cómputo amplio, con 128 unidades de cómputo, 8.192 Stream Processors y 512 Matrix Cores.

El conjunto trabaja con una frecuencia máxima de 2.200 MHz y alcanza los 73.000 millones de transistores, una cifra notable para una tarjeta PCIe enfocada a servidores. AMD también integra 128 MB de Infinity Cache, junto a 144 GB de HBM3E sobre un bus de 4.096 bits, suficiente para ofrecer hasta 4 TB/s de ancho de banda.

La comparación con la MI350X deja clara la segmentación. El modelo superior alcanza 288 GB de HBM3E sobre un bus de 8.192 bits, mientras que la MI350P reduce memoria e interfaz para encajar en una tarjeta PCIe más flexible. No busca reemplazar al acelerador de mayor escala, sino abrir una vía de despliegue más sencilla para cargas empresariales de IA.

Hasta 4,6 PFLOPs en MXFP4 para cargas de IA empresarial

En rendimiento, la Instinct MI350P apunta alto dentro del formato PCIe. AMD habla de hasta 4,6 PFLOPs en MXFP4, otros 4,6 PFLOPs en MXFP6, 2,3 PFLOPs en MXFP8 y hasta 2,3 PFLOPs en FP16 con sparsity. Para cargas más tradicionales, la tarjeta ofrece 72 TFLOPs en FP32, 72 TFLOPs en FP16 y 36 TFLOPs en FP64.

La clave no está únicamente en las cifras máximas, sino en el soporte nativo de formatos MXFP4 y MXFP6 para inferencia de alta densidad, cada vez más relevantes en modelos grandes. Estos formatos permiten elevar el rendimiento efectivo cuando la carga admite menor precisión, reduciendo presión sobre memoria, consumo y latencia sin depender siempre de FP16 o BF16.

AMD también destaca el soporte de sparsity en precisiones de 8 bits y 16 bits, con hasta 4,6 POPs en INT8 con sparsity. En despliegues reales de IA empresarial, esa combinación puede marcar diferencias en coste operativo, especialmente cuando el objetivo consiste en atender muchas peticiones de inferencia con una infraestructura ya amortizada.

AMD busca competir con NVIDIA H200 NVL en el segmento PCIe

El rival más directo de la Instinct MI350P sería la NVIDIA H200 NVL, una tarjeta PCIe basada en Hopper con 141 GB de HBM3E. La comparación tiene sentido por memoria, formato y orientación empresarial, aunque AMD intenta diferenciarse con una pila abierta apoyada en ROCm, además de opciones de desarrollo de bajo coste o sin coste adicional.

NVIDIA también cuenta con la RTX PRO 6000 Blackwell Server Edition, pero esa propuesta se apoya en el chip GB202 y monta 96 GB de GDDR7, por lo que no ocupa exactamente el mismo perfil que una solución con HBM3E. La H200 NVL, con precios aproximados entre 30.000$ y 40.000$ (~25.536€ y ~34.048€), sigue siendo el punto de referencia económico dentro de este tipo de aceleradores.

La lectura de fondo queda clara: AMD quiere que la familia Instinct MI350 no quede limitada a grandes despliegues especializados. Con la MI350P, la compañía ofrece una alternativa PCIe para empresas que necesitan más inferencia local, memoria HBM3E amplia y compatibilidad con servidores ya instalados, manteniendo una ruta de adopción menos rígida para la próxima oleada de IA empresarial.

Vía: Wccftech