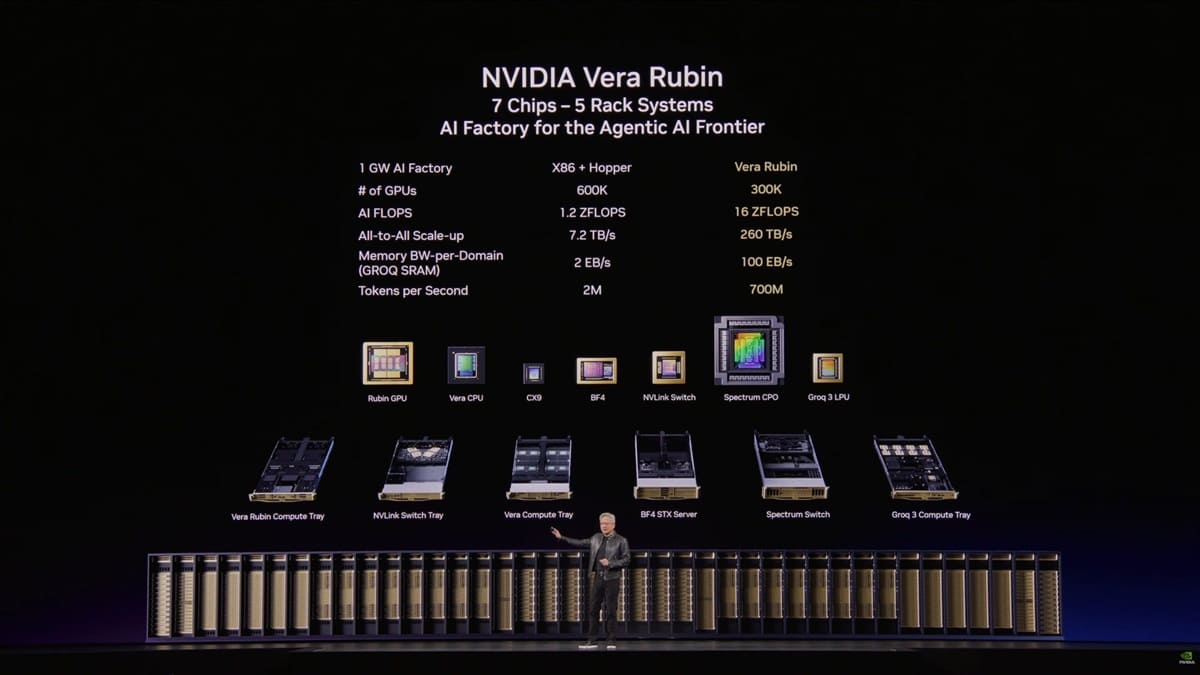

NVIDIA ha presentado su nueva plataforma de centros de datos de IA Vera Rubin, una arquitectura de próxima generación que integra GPU Rubin, CPU Vera y un ecosistema completo de racks y chips especializados para escalar la computación acelerada en entornos de IA generativa. Esta nueva propuesta representa un salto importante en capacidad de cálculo, con una evolución que la compañía sitúa en torno a 40.000.000 veces más potencia en una década.

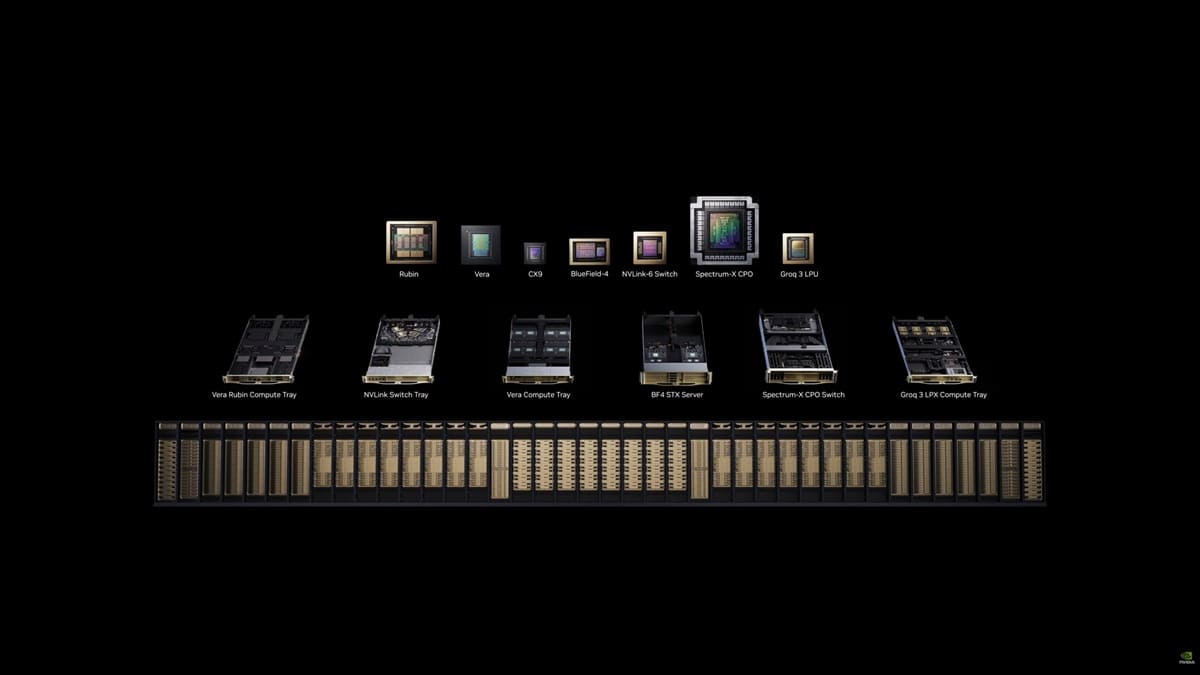

La plataforma combina hasta 7 tipos de chips dentro de una infraestructura modular compuesta por distintos racks, cada uno optimizado para tareas específicas como cómputo, interconexión, almacenamiento o inferencia. Entre los componentes clave destacan la GPU Rubin, la CPU Vera, el sistema de interconexión NVLink de sexta generación, las soluciones de red Spectrum-X y las unidades Groq3 LPU orientadas a cargas de baja latencia.

Rubin GPU y Vera CPU redefinen la base del cómputo en IA

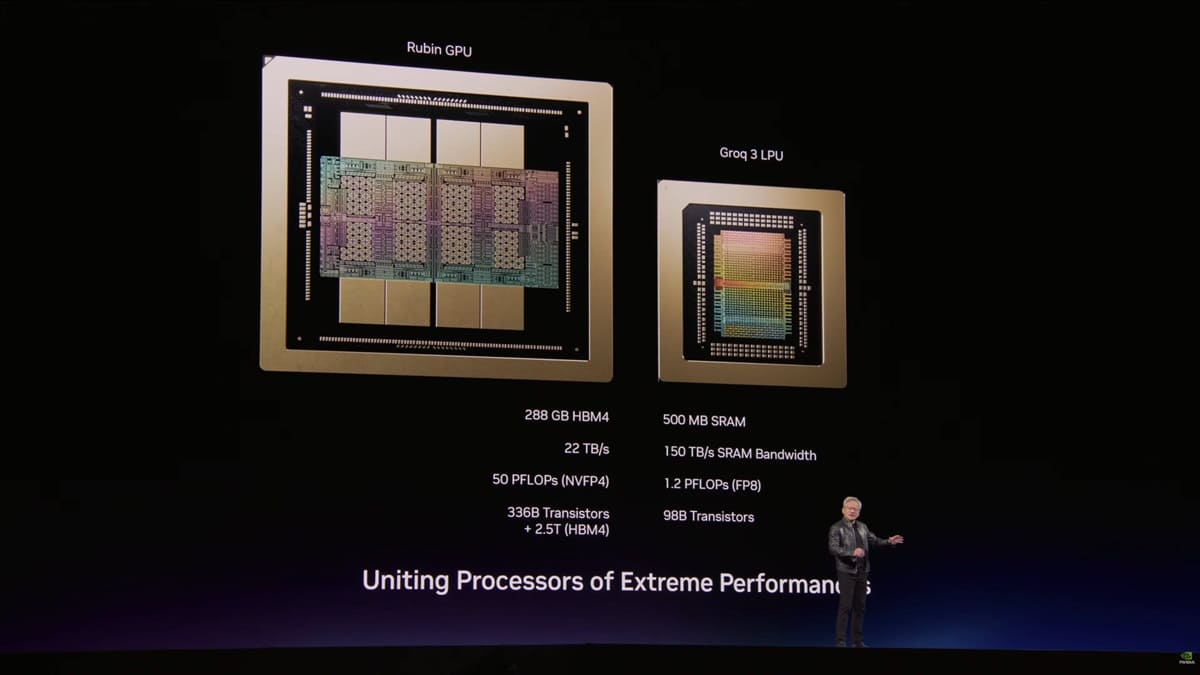

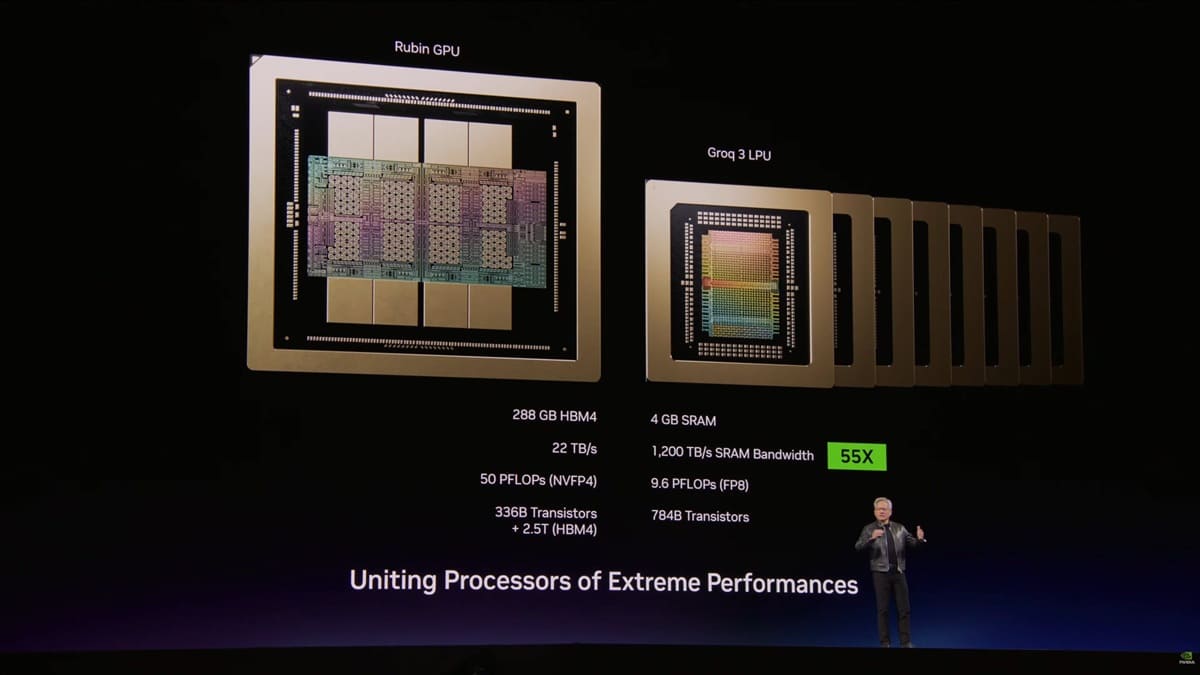

El núcleo de la plataforma lo forman las nuevas GPU Rubin, diseñadas con un enfoque extremo en rendimiento y ancho de banda. Cada chip integra 288 GB de memoria HBM4 con un ancho de banda de hasta 22 TB/s, junto a una capacidad de cálculo de hasta 50 PFLOPs en precisión NVFP4. Además, cada unidad cuenta con aproximadamente 336.000 millones de transistores, a los que se suman más de 2,5 billones adicionales procedentes de la memoria HBM4.

Estas GPU se integran en bandejas de cómputo completamente refrigeradas por líquido a 45 °C, un diseño que reduce la presión térmica en los centros de datos y permite instalaciones mucho más rápidas, pasando de dos días a apenas dos horas en despliegues completos.

Por su parte, la nueva CPU Vera introduce una arquitectura optimizada para centros de datos, con un enfoque en rendimiento por vatio, alto rendimiento monohilo y un elevado caudal de datos. Se trata además de la primera CPU de este segmento en utilizar memoria LPDDR5, lo que refuerza su eficiencia energética en cargas de IA a gran escala.

Infraestructura modular con NVLink, BlueField-4 y Spectrum-X

La plataforma Vera Rubin se apoya en una arquitectura modular que combina múltiples racks especializados. Entre ellos destaca el sistema de interconexión NVLink de sexta generación, capaz de alcanzar velocidades de hasta 260 TB/s, lo que permite conectar grandes clústeres de GPU con una latencia extremadamente baja.

También se incorpora el DPU BlueField-4, encargado de gestionar tareas de red, seguridad y almacenamiento dentro del centro de datos, junto a una nueva plataforma de almacenamiento denominada BlueField-4 STX, diseñada específicamente para soportar las exigencias de la IA generativa.

En el apartado de red, NVIDIA introduce Spectrum-X CPO, un switch con óptica coempaquetada fabricado por TSMC, que busca mejorar la eficiencia energética y el rendimiento en comunicaciones dentro de infraestructuras de gran escala.

A esto se suma el sistema ConnectX-9, orientado a conectividad de alta velocidad, completando un ecosistema donde cada componente está optimizado para maximizar el rendimiento global del centro de datos.

Vera Rubin NVL72: hasta 3,6 ExaFLOPS y salto en eficiencia energética

El máximo exponente de esta plataforma es el rack Vera Rubin NVL72, una configuración que integra 72 GPU Rubin y 36 CPU Vera, alcanzando hasta 3,6 ExaFLOPS de rendimiento en inferencia NVFP4. Este sistema también ofrece hasta 1,6 PB/s de ancho de banda de memoria HBM4 y una mejora de hasta 10 veces en rendimiento por vatio respecto a la generación anterior.

Además, la compañía ha confirmado que la plataforma contará con un amplio respaldo del ecosistema, incluyendo proveedores cloud como Amazon Web Services, Google Cloud, Microsoft Azure y Oracle Cloud, así como fabricantes de servidores como Dell Technologies, HPE, Lenovo o Supermicro.

Los primeros sistemas basados en Vera Rubin comenzarán a llegar al mercado durante la segunda mitad de este año, marcando el inicio de una nueva etapa en el despliegue de infraestructuras para IA de próxima generación.

Vía: Wccftech