NVIDIA vuelve a marcar el ritmo en el sector de IA con el despliegue de Groq 3 LPX, una solución centrada en la inferencia de IA que acompaña a su plataforma Vera Rubin. Este movimiento responde al crecimiento de la IA agéntica, donde la ejecución de modelos en tiempo real exige optimizar la latencia, el flujo de datos y el uso de silicio especializado en centros de datos.

Más allá del plano técnico, el impacto se traslada a la cadena de suministro global, donde Foxconn se posiciona como socio clave en la producción. La combinación de arquitectura LPU, escalado industrial y presión de demanda convierte esta plataforma en un pilar dentro de la nueva generación de infraestructura de IA.

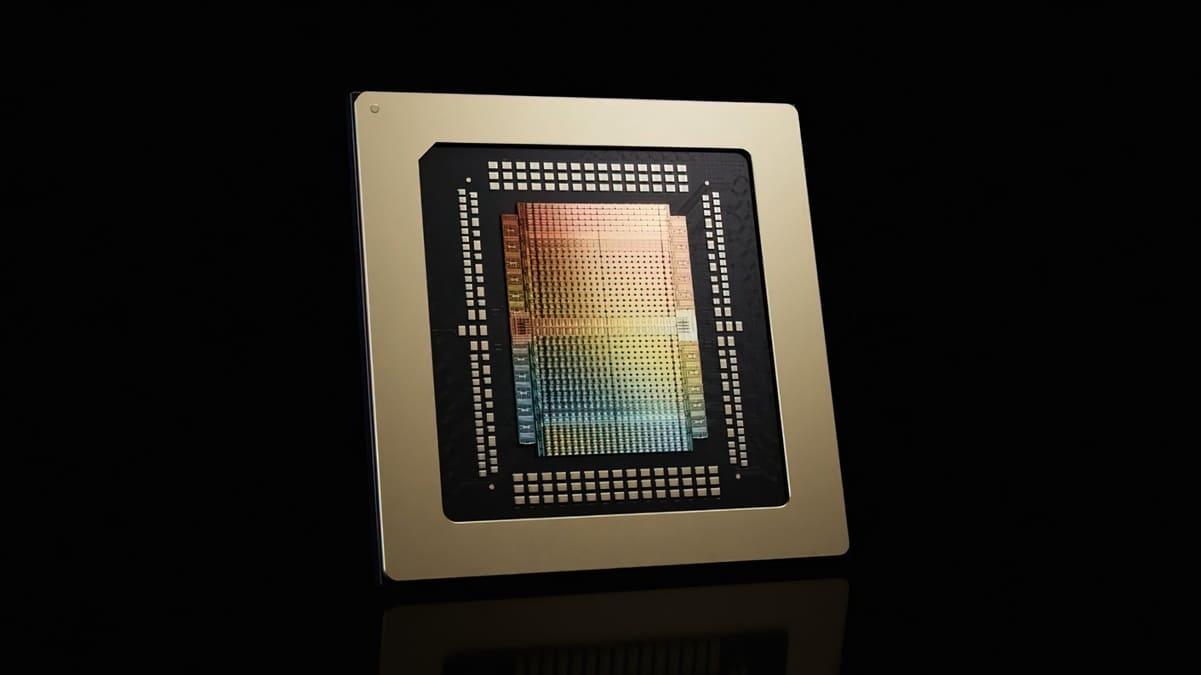

Groq 3 LPX redefine la inferencia con arquitectura LPU

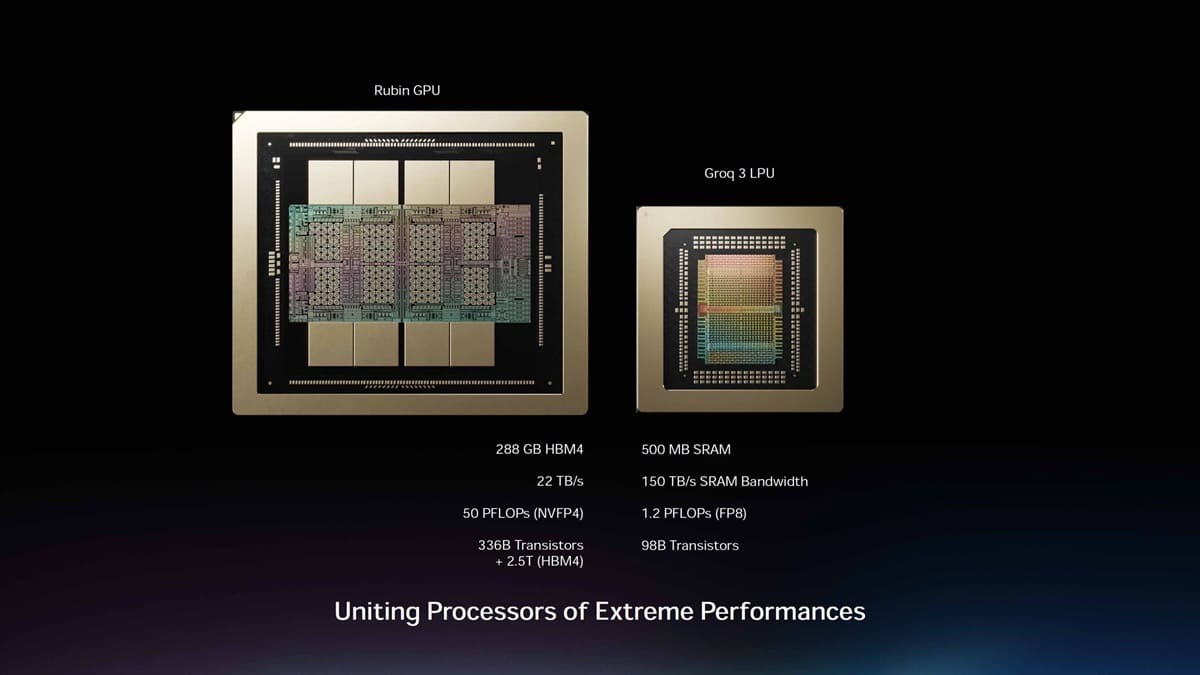

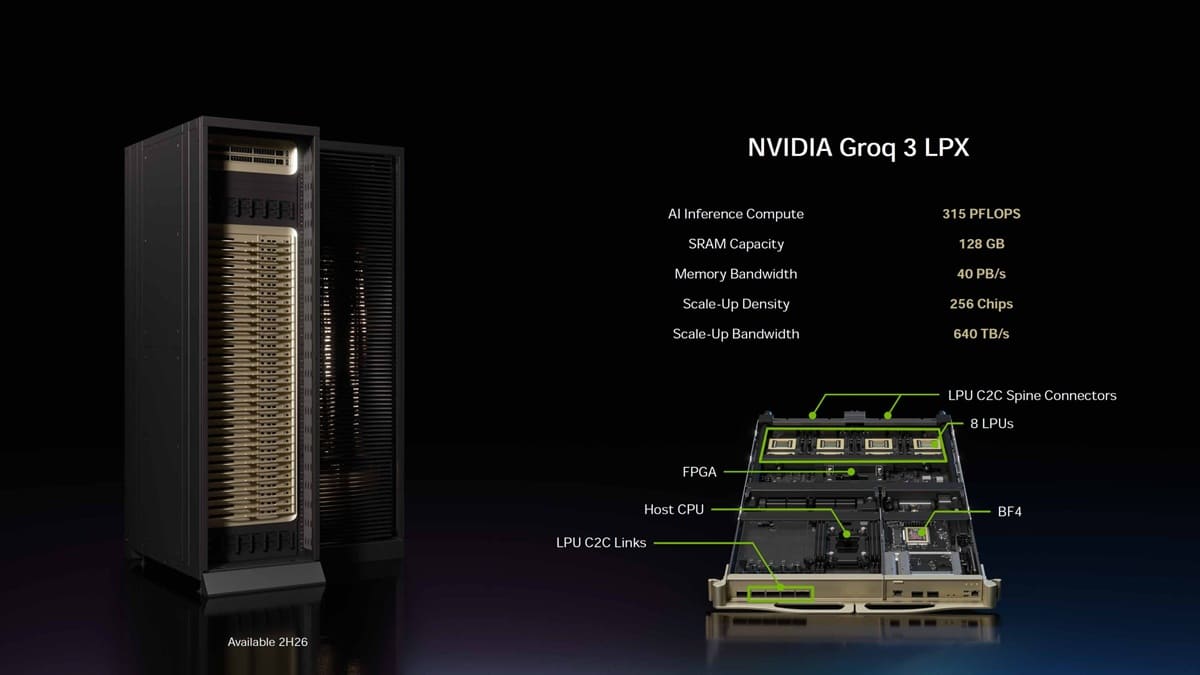

El Groq 3 LPX introduce una arquitectura LPU (Language Processing Unit) diseñada para acelerar la inferencia hasta 35x, un salto que no depende solo de potencia, sino de optimizar la ejecución de modelos y reducir cuellos de botella en la latencia y el ancho de banda interno.

Cada rack integra 256 chips, junto a 128 GB de SRAM y 12 TB de memoria DDR5, una configuración pensada para manejar modelos de múltiples billones de parámetros. Este enfoque posiciona a LPX como una solución orientada a la ejecución continua, donde la eficiencia en el procesamiento inferencial resulta crítica.

Producción adelantada y Foxconn como eje industrial

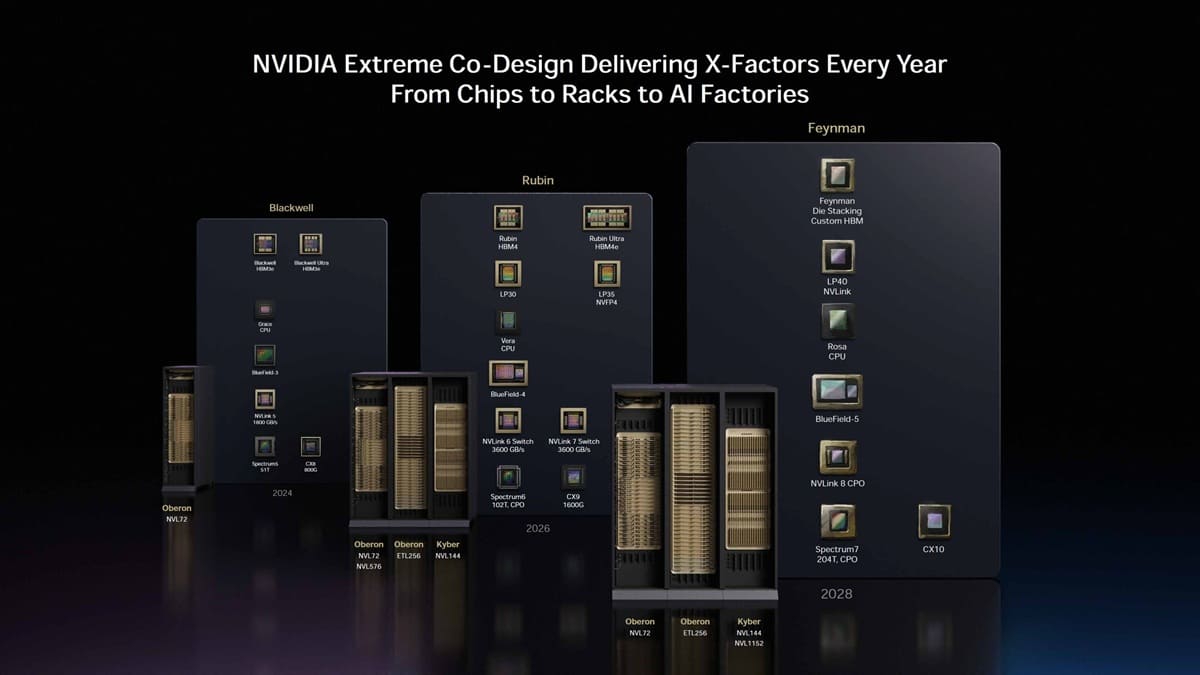

Los informes apuntan a envíos adelantados al tercer trimestre de 2026, reflejando la urgencia de NVIDIA por cubrir la demanda en IA inferencial. Las cifras lo confirman: los chips LP30 y LP35 alcanzarán aproximadamente 1,5 millones de unidades en 2026 y escalarán hasta 2,5 millones en 2027, consolidando un crecimiento sostenido.

En este contexto, Foxconn actúa como proveedor exclusivo del computing tray y principal ensamblador de los racks LPX, elevando su cuota del 55% al 60%. Además, las previsiones de 6.000 racks en 2026 y 10.000 en 2027 refuerzan su papel dentro de la infraestructura de IA global.

Vera Rubin como plataforma base del nuevo ciclo de IA

El despliegue de Groq 3 LPX se integra dentro del ecosistema Vera Rubin, donde los racks NVL72 representan la base de la infraestructura. Se espera que estos sistemas alcancen unas 12.000 unidades en 2026, con clientes como Google, Amazon AWS y Microsoft, reflejando una adopción masiva en el mercado.

La producción de los sistemas VR200 NVL72 arrancará a finales del Q3 2026, consolidando un entorno donde entrenamiento e inferencia conviven dentro de una misma arquitectura. Este modelo refuerza el papel del silicio de CPU y aceleradores específicos dentro del rendimiento global.

La inferencia pasa al centro: cambio real en el mercado de IA

El lanzamiento de Groq 3 LPX confirma un cambio estructural en el mercado: la inferencia de IA deja de ser secundaria y pasa a convertirse en el eje del crecimiento. Mientras el entrenamiento sigue siendo clave, la ejecución eficiente de modelos en producción es ahora el verdadero reto técnico.

Este cambio impulsa arquitecturas como las LPU, diseñadas para optimizar la eficiencia operativa en escenarios reales. En este contexto, NVIDIA redefine el equilibrio del sector, donde la capacidad de ejecutar modelos a gran escala será el factor determinante en la evolución de la IA moderna.

Vía: Wccftech