Hoy, durante el evento Six Five Summit, Intel ha desvelado su visión para la unidad de procesamiento de infraestructura (IPU, por sus siglas en inglés), un dispositivo de red programable diseñado para permitir a los proveedores de servicios de comunicaciones y de la nube reducir la sobrecarga y liberar el rendimiento de las unidades centrales de procesamiento (CPUs, por sus siglas en inglés). Con una IPU, los clientes utilizarán mejor los recursos con una solución segura, programable y estable que les permita equilibrar el procesamiento y el almacenamiento.

“La IPU es una nueva categoría de tecnologías y es uno de los pilares estratégicos de nuestra estrategia en la nube. Amplía nuestras capacidades de SmartNIC y está diseñada para abordar la complejidad y las ineficiencias del actual centro de datos. En Intel estamos comprometidos con crear soluciones e innovar junto con nuestros clientes y socios — la IPU es un ejemplo de esta colaboración.”

– Guido Appenzeller, chief technology officer, Data Platforms Group, Intel

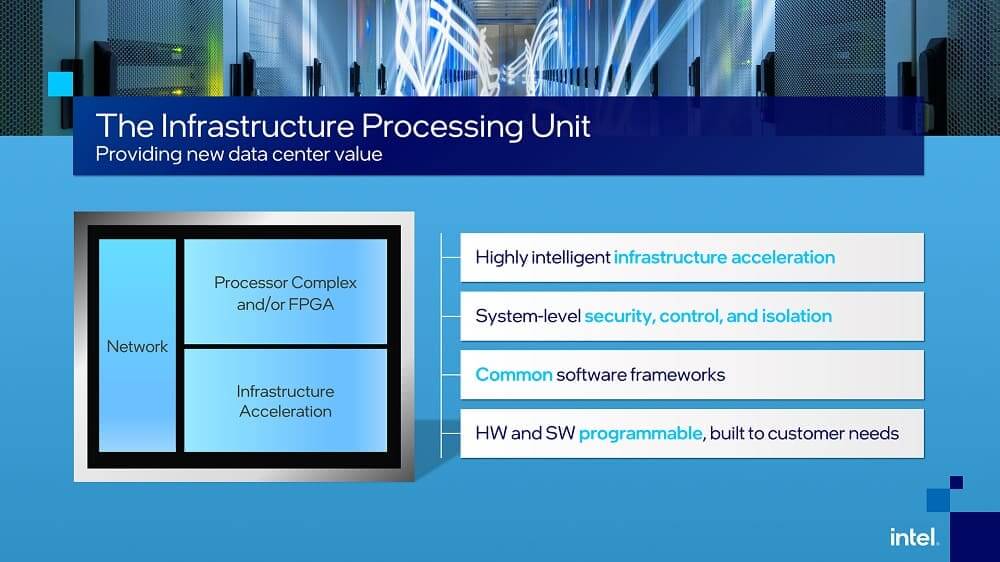

La IPU es un dispositivo de red programable que gestiona de forma inteligente los recursos de infraestructura a nivel de sistema acelerando de forma segura esas funciones en un centro de datos.

Permite a los operadores de la nube cambiar a una arquitectura de almacenamiento y red totalmente virtualizada, manteniendo al mismo tiempo un alto rendimiento y predictibilidad, así como un alto grado de control.

La IPU tiene una funcionalidad destinada a acelerar las aplicaciones modernas que se construyen utilizando una arquitectura basada en microservicios en el centro de datos. Las investigaciones de Google y Facebook han demostrado que entre el 22% y el 80% de los ciclos de la CPU pueden ser consumidos por la sobrecarga de comunicación de los microservicios.

Con la IPU, un proveedor de la nube puede gestionar de forma segura las funciones de la infraestructura al mismo tiempo que permite a su cliente controlar por completo las funciones de la CPU y la memoria del sistema.

Una IPU ofrece la posibilidad de:

- Acelerar las funciones de infraestructura, incluyendo la virtualización del almacenamiento, la virtualización de la red y la seguridad con aceleradores de protocolo específicos.

- Liberar núcleos de la CPU al cambiar las funciones de virtualización de red y almacenamiento que se realizaban anteriormente en el software de la CPU a la IPU.

- Mejorar la utilización del centro de datos al permitir la asignación flexible de las cargas de trabajo.

- Permitir a los proveedores de servicios en la nube personalizar las implementaciones de funciones de infraestructura a la velocidad del software.

“Como resultado de la colaboración de Intel con una mayoría de hiperescaladores, Intel ya es el líder en volumen en el mercado de IPU con nuestros componentes Xeon-D, FPGA y Ethernet”, señala Patty Kummrow, vice president in the Data Platforms Group and general manager of Ethernet Products Group at Intel. “Las primeras plataformas de IPU de Intel basadas en FPGA están implementadas en múltiples proveedores de servicios en la nube y nuestra primera IPU ASIC está en fase de pruebas”.

“Desde antes de 2015, Microsoft fue pionera en el uso de SmartNICs reconfigurables en múltiples generaciones de servidores Intel para descargar y acelerar las pilas de red y almacenamiento a través de servicios como Azure Accelerated Networking. La SmartNIC nos permite liberar núcleos de procesamiento, escalar a anchos de banda IOPS de almacenamiento mucho mayores, añadir nuevas capacidades después de la implementación, y proporcionar un rendimiento predecible a nuestros clientes de la nube.” Asegura Andrew Putnam, , principal Hardware Engineering manager at Microsoft. “Intel ha sido nuestro socio de confianza desde el principio, y nos alegra ver que Intel sigue promoviendo una visión sólida de la industria para el centro de datos del futuro con la unidad de procesamiento de infraestructura”.

Intel lanzará nuevas plataformas IPU basadas en FPGA y ASICs dedicados. Estas soluciones estarán habilitadas por una base de software potente que permite a los clientes crear un software de orquestación de la nube de vanguardia.

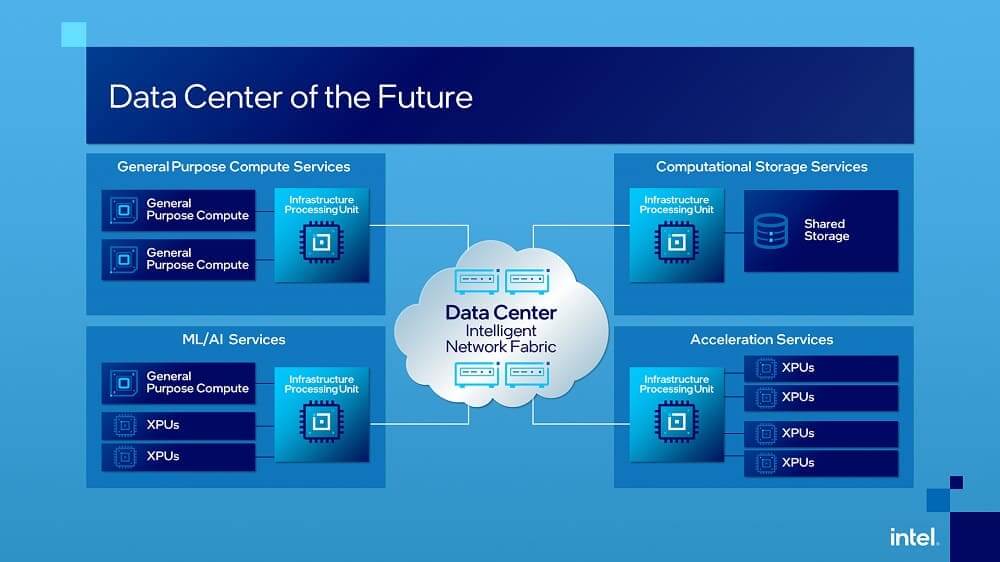

Los centros de datos en evolución requerirán una nueva arquitectura inteligente en la que la computación heterogénea distribuida a gran escala funcione conjuntamente y se conecte perfectamente para mostrarse como una única plataforma de computación. Esta nueva arquitectura ayudará a resolver los retos actuales sobre recursos bloqueados, flujos de datos congestionados y seguridad de la plataforma incompatible. De este modo, esta arquitectura de centro de datos inteligente tendrá tres categorías de computación –CPU para la computación de propósito general, XPU para la aplicación específica o para la aceleración de la carga de trabajo específica, y IPU para la aceleración de la infraestructura- que se conectarán a través de redes programables para utilizar eficientemente los recursos del centro de datos.