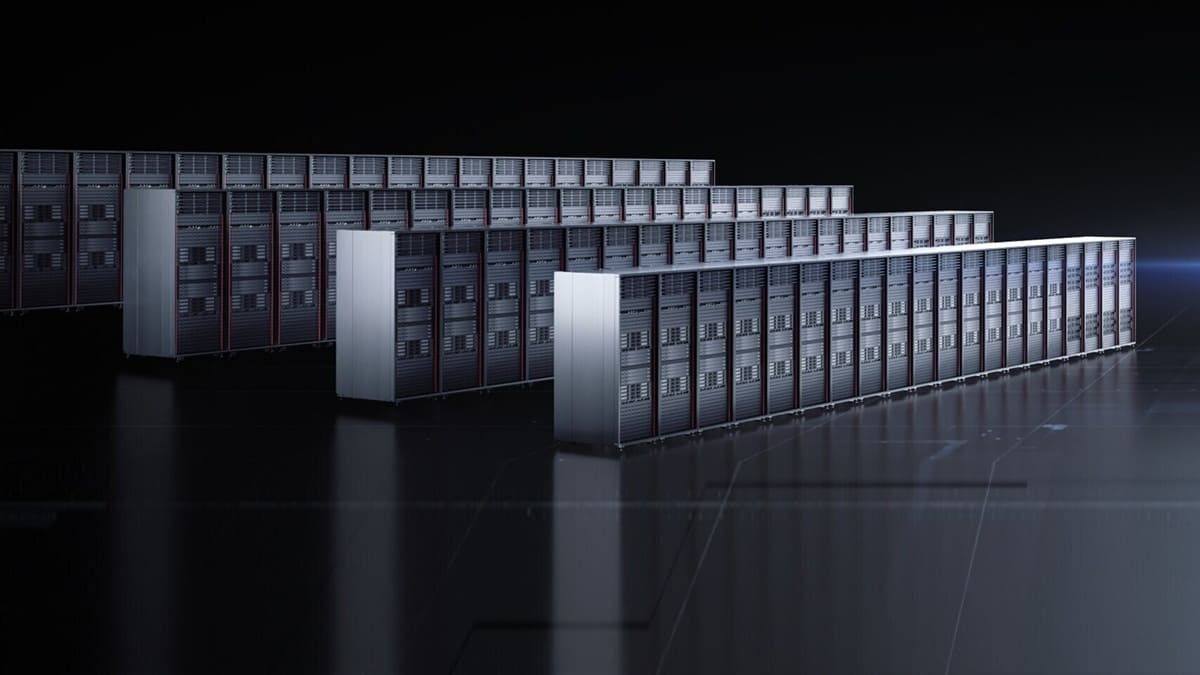

En MWC Barcelona 2026, Huawei ha mostrado el Atlas 950 SuperPoD, una infraestructura de IA a gran escala diseñada para agrupar hasta 8.192 NPUs dentro de un mismo dominio lógico coherente gracias a la interconexión UnifiedBus. El anuncio no gira en torno a un servidor aislado, sino a una arquitectura pensada para sostener modelos con billones de parámetros, donde la limitación ya no es la potencia de cálculo individual, sino la latencia inter-nodo, la coherencia de memoria y la eficiencia de comunicación interna.

Cuando un clúster crece hasta miles de aceleradores, la escalabilidad horizontal tradicional pierde eficiencia. En ese contexto, la interconexión y el diseño del sistema pesan más que el número bruto de núcleos.

UnifiedBus y el desafío real de escalar 8.192 NPUs

El Atlas 950 SuperPoD emplea la interconexión propietaria UnifiedBus, que permite enlazar hasta 8.192 NPUs con alto ancho de banda agregado, latencia reducida y direccionamiento unificado de memoria. En la práctica, el sistema funciona como un superordenador lógico único, en lugar de miles de nodos comunicándose a través de redes convencionales.

En entornos de entrenamiento distribuido e inferencia masiva, los problemas habituales incluyen la fragmentación de memoria, la sincronización entre aceleradores, la pérdida de eficiencia al escalar y el aumento de consumo energético por retransmisiones internas. Una arquitectura de interconexión cerrada busca precisamente reducir estos cuellos de botella, manteniendo estabilidad y coherencia en cargas de gran tamaño dentro del sector de IA de gran escala.

Huawei también mostró el Atlas 850E, una variante orientada a infraestructuras empresariales con menor densidad de aceleradores pero bajo el mismo esquema de interconexión.

TaiShan 950 SuperPoD y computación de propósito general

Junto al sistema basado en NPUs, la compañía presentó el TaiShan 950 SuperPoD, descrito como una plataforma de computación de propósito general a gran escala, acompañada por los servidores TaiShan 500 y TaiShan 200. Aquí el enfoque no es maximizar aceleradores dedicados, sino ofrecer capacidad para cargas mixtas, desde bases de datos hasta análisis intensivo y servicios distribuidos.

En centros de datos actuales, la coexistencia de CPU de propósito general y aceleradores especializados es cada vez más habitual. Separar ambos entornos en silos independientes complica la gestión de recursos y eleva la latencia interna, por lo que las arquitecturas híbridas buscan reducir esa fragmentación estructural.

CANN, compatibilidad con PyTorch y entorno openEuler

En la capa de software, Huawei reforzó su arquitectura CANN (Compute Architecture for Neural Networks), que incluye bibliotecas de operadores, librerías de aceleración, entornos de ejecución y herramientas compatibles con proyectos como PyTorch y vLLM. Más allá del discurso de apertura, el punto relevante es la integración con marcos ya utilizados en entrenamiento e inferencia a gran escala.

La compañía también mantiene su impulso en torno a openEuler, una distribución orientada a entornos empresariales. En infraestructuras de esta magnitud, la disponibilidad de un ecosistema compatible y estable resulta tan crítica como el propio silicio.

Infraestructura para modelos de próxima generación

El dato técnico central es claro: hasta 8.192 NPUs bajo un único dominio lógico coherente. En esta categoría, la diferencia no la marca solo la densidad de aceleradores, sino la eficiencia de interconexión, la latencia efectiva, el ancho de banda interno y la capacidad de mantener coherencia de memoria bajo carga sostenida.

Con el Atlas 950 SuperPoD, Huawei se posiciona en el segmento de infraestructura de entrenamiento masivo, donde la arquitectura del sistema es tan determinante como el rendimiento individual de cada acelerador dentro del ecosistema de IA distribuida.

Vía: TechPowerUp