Google y NVIDIA han ampliado su colaboración con el lanzamiento de las instancias A5X, orientadas a cargas de IA agentica dentro del entorno AI Hypercomputer. Más allá del anuncio, lo relevante es el objetivo: reducir el coste por inferencia y aumentar el rendimiento por vatio, dos variables que están redefiniendo la viabilidad económica de la IA a gran escala.

Este movimiento no es aislado. Apunta directamente al problema central de la industria: ejecutar modelos avanzados de forma rentable, no solo entrenarlos. En este contexto, A5X se posiciona como infraestructura crítica más que como simple mejora incremental.

Escala real: de clústeres a sistemas distribuidos masivos

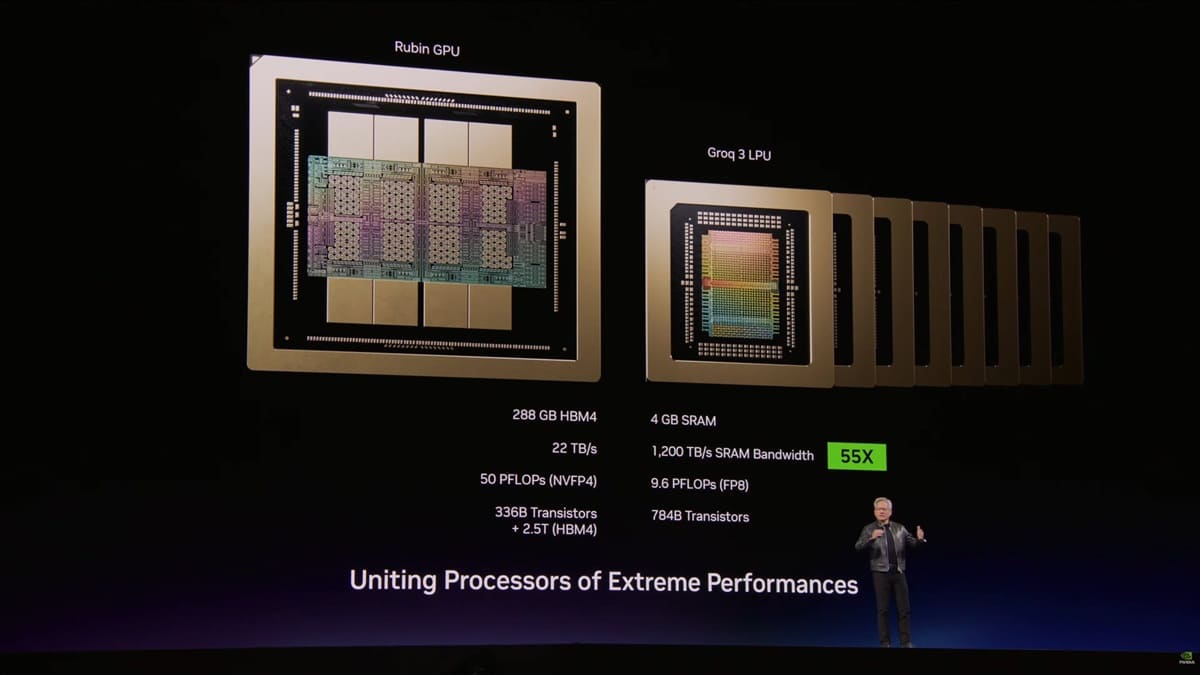

Las A5X están diseñadas para trabajar con GPUs Rubin de NVIDIA, permitiendo conectar hasta 80.000 GPUs en un único clúster y cerca de 960.000 en entornos multisitio. Esto no es solo un salto de escala, sino un cambio en cómo se construyen y operan sistemas de IA, pasando de clústeres tradicionales a infraestructuras distribuidas de enorme tamaño.

Aquí está la clave: la IA agentica necesita paralelismo masivo y coordinación entre nodos, algo que solo es viable con este nivel de interconexión. Sin esa escala, muchos modelos simplemente no pueden ejecutarse de forma eficiente.

Red e interconexión: donde se gana o se pierde el rendimiento

El uso de NICs ConnectX-9 de NVIDIA junto a la plataforma Virgo de Google es determinante. La red deja de ser un componente secundario y pasa a ser el cuello de botella principal en sistemas de IA, especialmente cuando se trabaja con cientos de miles de GPUs.

Virgo permite conectar más de un millón de aceleradores entre distintos centros de datos, lo que introduce un modelo de computación distribuida a gran escala. La eficiencia ya no depende solo del chip, sino de la velocidad a la que los datos se mueven entre nodos, algo crítico en inferencia y entrenamiento.

Inferencia como campo de batalla: el cambio estructural de la IA

Según NVIDIA, A5X logra hasta 10 veces menos coste por inferencia y 10 veces más rendimiento por megavatio. Más allá de la cifra, esto tiene una implicación directa: la inferencia se convierte en el verdadero campo de batalla económico de la IA.

Hasta la fecha, el foco estaba en entrenar modelos cada vez más grandes. Ahora, el problema es otro. Ejecutar esos modelos de forma continua y rentable es lo que define su viabilidad real, especialmente en servicios que operan a escala global.

IA agentica: más complejidad, más dependencia de infraestructura

Las A5X están diseñadas para cargas de IA agentica, donde múltiples agentes colaboran para resolver tareas de forma distribuida. Este modelo incrementa la complejidad computacional y la dependencia de infraestructura escalable, ya que cada agente requiere recursos y coordinación en tiempo real.

En este contexto, la infraestructura deja de ser soporte y pasa a ser protagonista. Sin sistemas capaces de sostener ese nivel de paralelismo, la IA agéntica no es viable a gran escala, lo que eleva la importancia de plataformas como A5X.

Más allá del anuncio: infraestructura como ventaja competitiva

Este movimiento deja una lectura clara del sector. La competencia ya no está solo en modelos, sino en quién puede operarlos a gran escala con costes sostenibles, algo que redefine la posición de cada actor.

Aquí es donde Google y NVIDIA están moviendo ficha. Controlar la infraestructura significa controlar el coste, el rendimiento y la capacidad de despliegue de la IA, tres factores que determinan quién lidera el mercado en los próximos años.

Vía: Wccftech