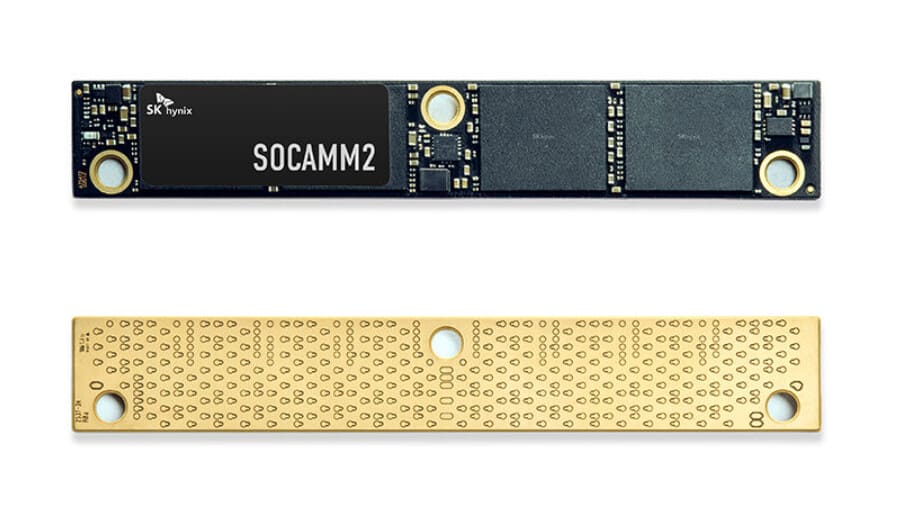

SK hynix ha puesto en marcha la producción en masa de módulos SOCAMM2 de 192 GB, una propuesta que rompe con el modelo clásico del servidor al introducir memoria LPDDR5X de bajo consumo en el entorno de infraestructura de IA. Este movimiento cuestiona directamente el papel de los RDIMM tradicionales, ya que prioriza eficiencia energética, densidad y ancho de banda en un contexto donde el consumo empieza a ser tan limitante como el propio rendimiento.

El desarrollo se apoya en el nodo 1cnm (sexta generación de 10 nm), lo que permite mejorar el rendimiento sin aumentar proporcionalmente el consumo energético, un punto crítico en centros de datos. Aquí no estamos ante una mejora incremental, sino ante un enfoque orientado a cargas de trabajo de IA sostenidas, donde la eficiencia por operación se convierte en un factor estructural para la escalabilidad del sistema.

SOCAMM2 cambia el equilibrio entre consumo y rendimiento

La base de SOCAMM2 consiste en trasladar la memoria LPDDR5X, habitual en dispositivos móviles, a entornos donde el rendimiento continuo es clave. Esta adaptación permite reducir el consumo por operación sin renunciar a una alta densidad de memoria, algo especialmente relevante en sistemas que ejecutan cargas intensivas durante largos periodos de tiempo.

En términos técnicos, el salto es claro: el módulo ofrece más del doble de ancho de banda junto a una mejora superior al 75% en eficiencia energética frente a los RDIMM convencionales. Esto implica que los servidores pueden procesar más datos consumiendo menos energía, lo que impacta directamente en el coste operativo y en la capacidad de escalar infraestructuras de IA.

Este enfoque refuerza una tendencia evidente: la memoria deja de ser un componente pasivo y pasa a desempeñar un papel activo en el rendimiento real del sistema.

Diseñada para integrarse con NVIDIA Vera Rubin

El alineamiento con la plataforma NVIDIA Vera Rubin no es un detalle menor, ya que sitúa a SOCAMM2 dentro del ecosistema de aceleradores de IA de próxima generación. Esto indica que la memoria ha sido diseñada teniendo en cuenta arquitecturas específicas, no como una solución genérica adaptable.

Este tipo de integración permite optimizar el flujo de datos entre CPU, GPU y memoria, reduciendo latencias y mejorando el aprovechamiento del hardware disponible. En cargas de IA, donde el movimiento de datos es crítico, esta optimización puede marcar una diferencia real en rendimiento.

En la práctica, esto supone que la memoria pasa a formar parte de un stack tecnológico cohesionado, donde cada componente está pensado para trabajar de forma sincronizada.

El cuello de botella de los LLM entra en el punto de mira

Los modelos de lenguaje con cientos de miles de millones de parámetros han puesto en evidencia que la memoria es uno de los principales cuellos de botella. En este escenario, SOCAMM2 plantea una solución basada en alto ancho de banda y eficiencia energética, dos factores clave para mejorar tanto el entrenamiento como la inferencia.

La mejora no es solo teórica: al reducir la latencia en el acceso a datos y aumentar la capacidad de transferencia, el sistema puede procesar información de forma más rápida y eficiente. Esto se traduce en menores tiempos de ejecución y mejor aprovechamiento del hardware disponible.

La memoria gana protagonismo en la infraestructura de IA

El contexto actual del mercado está desplazando el foco hacia el entrenamiento intensivo de modelos, lo que obliga a replantear el papel de la memoria dentro del sistema. En este escenario, soluciones como SOCAMM2 buscan equilibrar consumo y rendimiento sin depender únicamente de la capacidad bruta.

El hecho de que SK hynix ya esté en fase de producción en masa indica que esta tecnología no se queda en el plano conceptual, sino que apunta a despliegues reales en centros de datos a corto plazo. Esto refuerza una idea clave dentro del sector.

En la práctica, la memoria deja de ser un elemento secundario y pasa a condicionar directamente la eficiencia, escalabilidad y rendimiento global de las infraestructuras de IA.

Vía: TechPowerUp