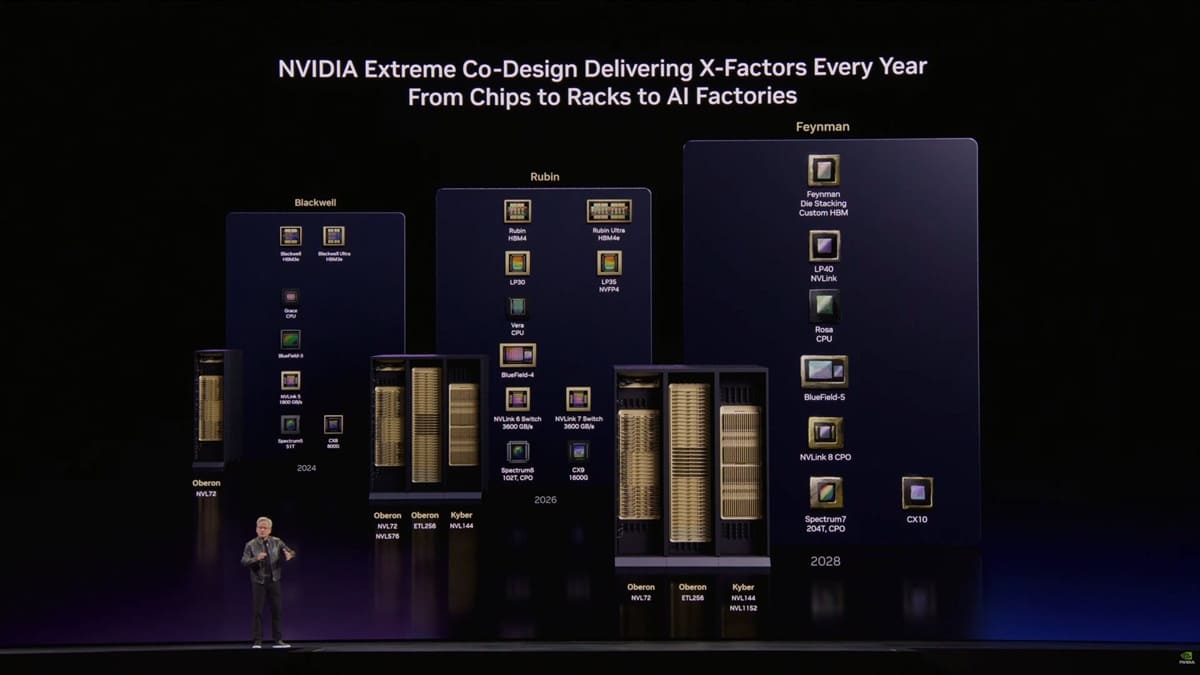

NVIDIA ha revelado nuevos detalles sobre su futura plataforma de centros de datos de IA Rosa Feynman, una arquitectura que marcará la siguiente generación tras Vera Rubin y que introduce cambios relevantes en el diseño de silicio de GPU, el encapsulado avanzado y el subsistema de memoria. La compañía ha confirmado que sus futuras GPU Feynman adoptarán tecnología de apilado de dies en 3D, un paso clave para escalar rendimiento y densidad en cargas de IA generativa.

Este movimiento sitúa a NVIDIA en una nueva fase dentro del sector de semiconductores, donde el avance ya no depende únicamente del nodo de fabricación, sino del uso de técnicas de empaquetado avanzado y arquitecturas tridimensionales para mejorar la comunicación entre dies y optimizar el rendimiento por vatio en centros de datos.

Feynman apuesta por GPU con apilado de dies en 3D y encapsulado avanzado

Uno de los cambios más relevantes de la arquitectura Feynman es la adopción del apilado de dies en 3D, una técnica que permite integrar múltiples dies dentro de un mismo paquete para aumentar la densidad de transistores y mejorar la eficiencia en el intercambio de datos.

En este contexto, NVIDIA podría introducir por primera vez GPU con dies apilados en 3D, lo que supondría una evolución frente a los diseños actuales basados en chiplets distribuidos en un mismo plano. Esta aproximación permite reducir latencias internas y mejorar el comportamiento en cargas de IA a gran escala, donde la proximidad entre componentes resulta crítica.

Además, la compañía ha confirmado que contará con Intel Foundry como socio en fabricación y encapsulado, aprovechando tecnologías como EMIB, que facilitan la interconexión eficiente entre múltiples dies dentro del mismo encapsulado.

Memoria HBM personalizada como eje diferencial

Otro de los aspectos clave es el cambio en la estrategia de memoria. Frente al uso estándar de HBM4 en la arquitectura Rubin o HBM4E en variantes posteriores, NVIDIA ha confirmado que las GPU Feynman emplearán una solución de memoria HBM personalizada.

Aunque no se han detallado especificaciones concretas, todo apunta a una evolución avanzada de HBM4E o incluso a una implementación basada en HBM5, orientada a mejorar el ancho de banda, la latencia y la eficiencia energética en cargas de IA generativa.

Este enfoque permitiría a NVIDIA diferenciarse frente a soluciones estándar del mercado, optimizando la relación entre memoria, cómputo y consumo energético en entornos donde los modelos de IA requieren cada vez más recursos.

Nueva CPU Rosa y ecosistema completo de chips

La arquitectura Rosa Feynman no se limita a las GPU. NVIDIA también ha confirmado el desarrollo de una nueva CPU Rosa, que sustituirá a Vera dentro de esta generación. Aunque no se han revelado detalles técnicos, se espera que mantenga un enfoque en alto rendimiento, eficiencia energética y gestión de datos en centros de IA a gran escala.

Junto a CPU y GPU, la plataforma integrará una nueva generación de componentes clave como BlueField-5, NVLink 8 CPO, Spectrum-7 y ConnectX-10, conformando un ecosistema completo para infraestructura de computación acelerada.

Este enfoque refuerza la estrategia de NVIDIA de controlar todos los elementos del sistema, desde el silicio de GPU hasta la red, el almacenamiento y la interconexión, algo esencial para escalar soluciones en entornos de hiperescaladores y proyectos de IA soberana.

Llegada en 2028 y salto estructural en el diseño de chips de IA

Según la hoja de ruta presentada, la plataforma Rosa Feynman llegará en torno a 2028, situándose como sucesora de Rubin y sus variantes. Este calendario refleja la evolución del sector hacia soluciones donde el avance no solo depende del nodo de fabricación, sino también del encapsulado y la integración tridimensional.

La adopción del apilado de dies en 3D y de una memoria HBM personalizada apunta a un cambio estructural en el diseño de chips para IA, donde la densidad de cálculo, la eficiencia energética y la optimización del sistema completo serán determinantes.

Con esta estrategia, NVIDIA busca mantener su liderazgo en el sector de centros de datos para IA, anticipándose a una nueva etapa marcada por modelos más complejos y una demanda creciente de infraestructura de alto rendimiento.

Vía: Wccftech