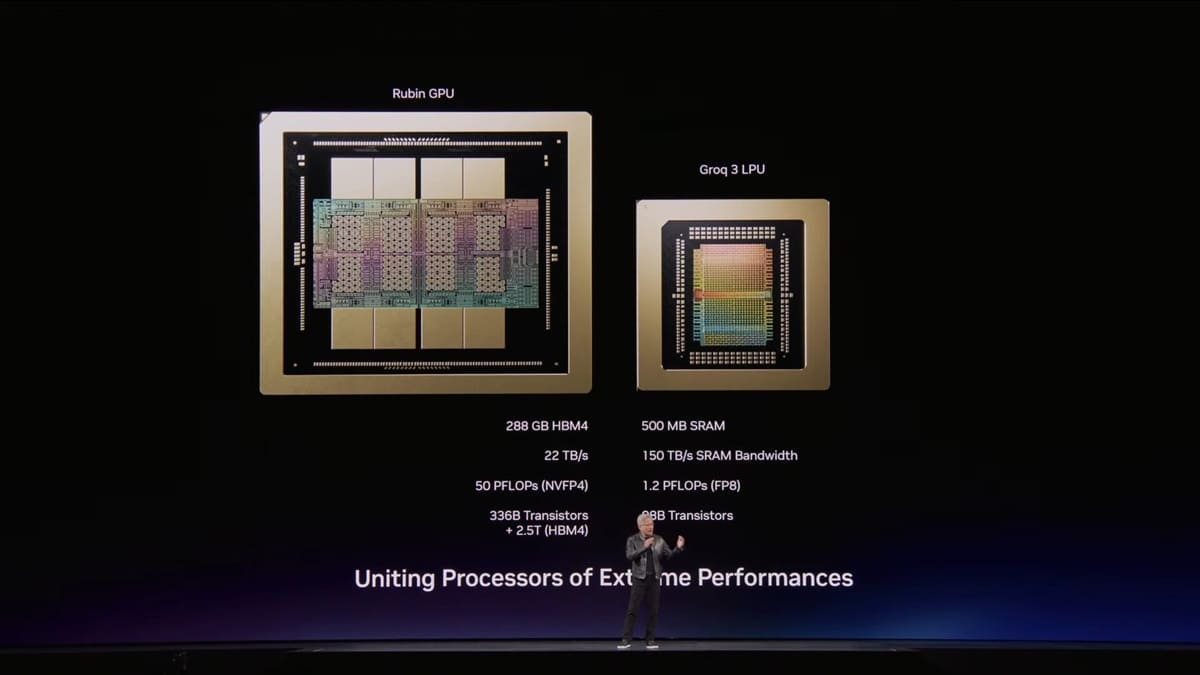

NVIDIA ha formalizado su colaboración con Groq tras presentar en GTC 2026 una nueva bandeja de cómputo híbrida dentro de la arquitectura Vera Rubin, diseñada para acelerar cargas de inferencia de IA de alta velocidad. Esta nueva solución combina GPU Rubin con las unidades LPU Groq3, una arquitectura orientada a reducir latencias y aumentar el rendimiento en modelos de gran tamaño utilizados en IA generativa.

La propuesta busca reforzar la posición de NVIDIA en el creciente mercado de la inferencia, donde cada vez más proveedores compiten por optimizar la ejecución de modelos en producción. Al combinar GPU y LPU dentro de la misma plataforma, la compañía pretende mejorar el rendimiento en tareas críticas como prefill y decode, dos fases fundamentales durante la ejecución de modelos de lenguaje de gran escala.

Rubin y Groq LPX apuntan a cargas de inferencia de alta velocidad

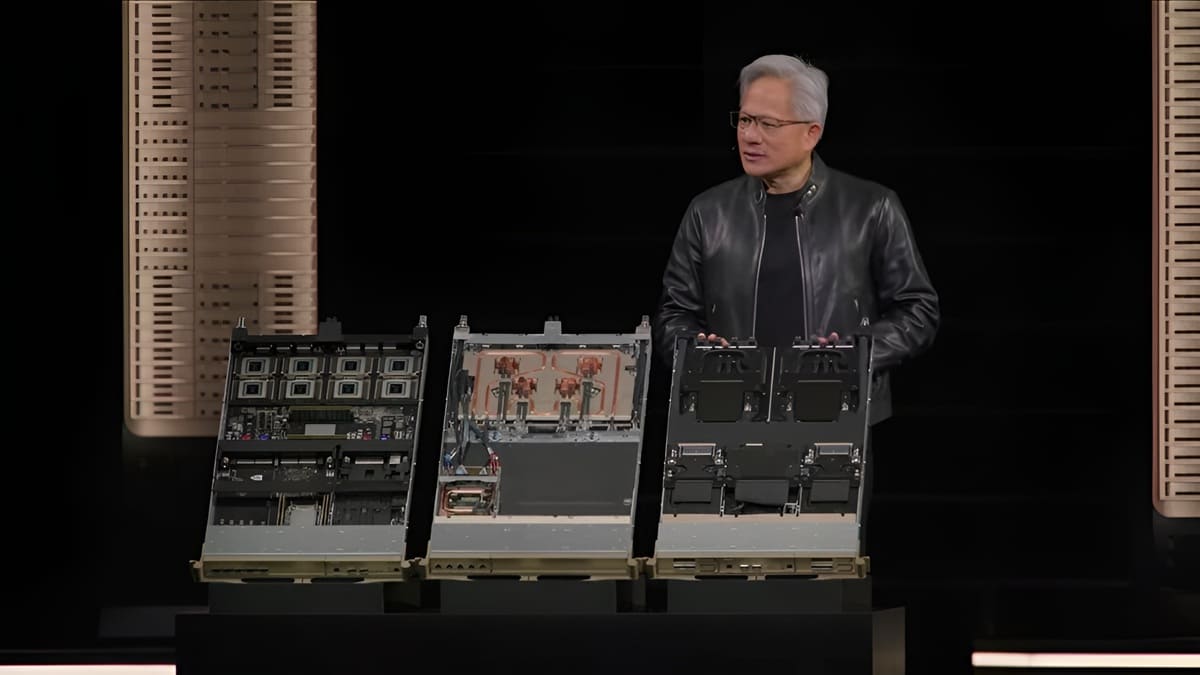

El nuevo sistema presentado por NVIDIA se basa en una bandeja de cómputo denominada Groq3 LPX, integrada dentro de racks Rubin. Cada bandeja incorpora ocho unidades Groq3, chips diseñados específicamente para ejecutar cargas de inferencia de IA con una latencia extremadamente baja.

A escala de rack, la plataforma puede alcanzar hasta 256 unidades LPU, con un total de 128 GB de SRAM integrada y un ancho de banda interno de 640 TB/s, cifras pensadas para manejar modelos de IA con billones de parámetros y contextos de hasta un millón de tokens.

Según las estimaciones de la compañía, esta combinación de GPU Rubin y LPU Groq3 permite alcanzar un aumento de hasta 35 veces en el rendimiento de inferencia por megavatio, lo que sitúa a esta arquitectura como una de las propuestas más ambiciosas dentro del sector de infraestructura para IA.

Las LPU Groq3 introducen una arquitectura optimizada para inferencia

Cada chip Groq3 integra aproximadamente 500 MB de memoria SRAM, acompañados de un ancho de banda interno de 150 TB/s, características pensadas para reducir los tiempos de acceso a memoria durante la ejecución de modelos de IA generativa.

En términos de potencia de cálculo, cada unidad alcanza aproximadamente 1,2 PFLOPs en precisión FP8, una cifra significativa para tareas de inferencia optimizada, donde el objetivo principal es maximizar el rendimiento por vatio y reducir la latencia en el procesamiento de tokens.

Cuando se combina esta arquitectura con las GPU Rubin, el sistema completo puede alcanzar hasta 315 PFLOPs dedicados a inferencia de IA, según explicó el propio Jensen Huang durante la presentación de la plataforma.

Una estrategia para competir en el mercado de inferencia de IA

La integración de Groq dentro del ecosistema de NVIDIA responde a la creciente competencia en el sector de infraestructura de IA, donde compañías como Cerebras están apostando por arquitecturas especializadas para ejecutar modelos de lenguaje de gran escala.

El objetivo de esta arquitectura híbrida es abordar tanto la fase inicial de cálculo (prefill) como la generación secuencial de tokens (decode), dos procesos críticos en sistemas de IA generativa que requieren diferentes tipos de hardware.

Según explicó Jensen Huang, la idea es que las LPU de Groq desempeñen un papel similar al que desempeñó Mellanox en el ámbito de las redes dentro del ecosistema de NVIDIA, aportando una especialización que complemente las capacidades de las GPU.

Con el crecimiento de la IA agentiva y el aumento constante de la demanda de infraestructura de cómputo acelerado, esta alianza podría convertirse en una pieza clave dentro de la estrategia de NVIDIA para mantener su liderazgo en el sector de centros de datos para IA.

Vía: Wccftech