NVIDIA se prepara para celebrar GTC 2026, uno de los eventos más importantes del calendario tecnológico para el sector de la inteligencia artificial y la computación acelerada. Este año, las expectativas son especialmente altas porque la compañía podría presentar cambios relevantes en la forma en que se construyen las infraestructuras de IA, ampliando su enfoque más allá del modelo tradicional basado únicamente en GPU.

Durante los últimos años, la evolución de las cargas de trabajo de IA generativa ha obligado a fabricantes como NVIDIA y AMD a replantear sus estrategias de hardware. Desde 2022, los sistemas basados en GPU Hopper y Blackwell han dominado el entrenamiento de modelos de gran tamaño, pero la industria empieza ahora a centrarse en nuevas fases de procesamiento, especialmente las relacionadas con inferencias complejas y cargas de trabajo agentic, donde el flujo de datos y las etapas de ejecución del modelo requieren arquitecturas más especializadas.

LPUs de Groq y el paso hacia plataformas híbridas de IA

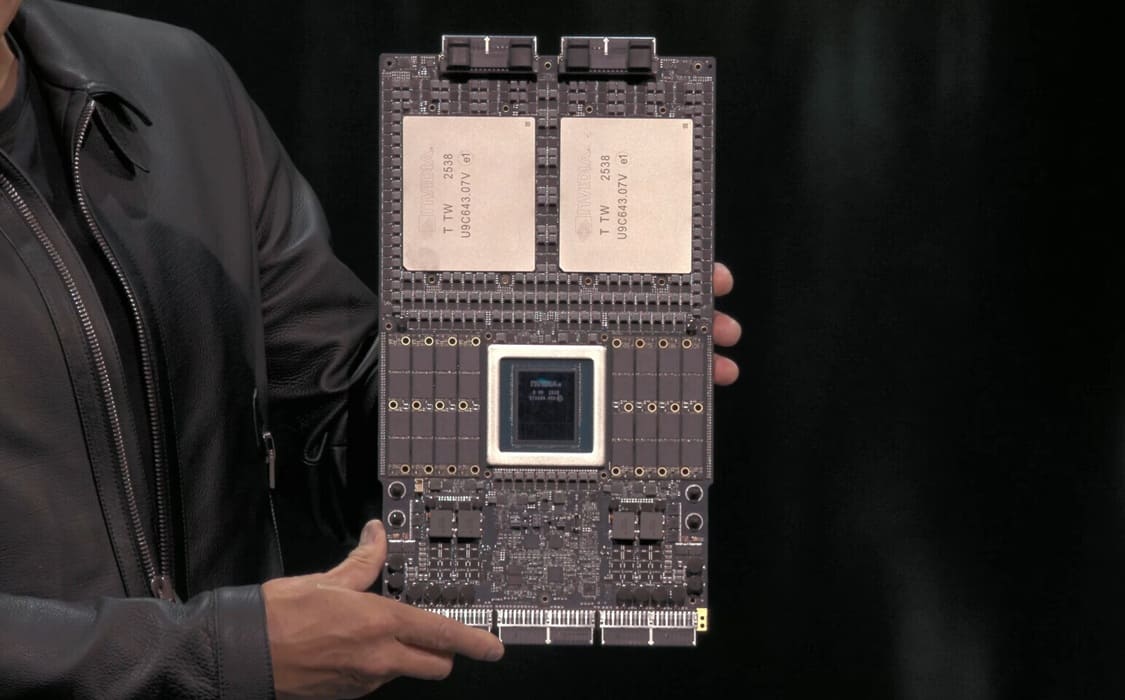

Uno de los movimientos más interesantes que podría materializarse durante GTC 2026 es la integración de las LPU (Language Processing Units) de Groq dentro del ecosistema de hardware de NVIDIA. Tras el acuerdo alcanzado entre ambas compañías, se espera que la colaboración empiece a tomar forma en sistemas comerciales basados en la arquitectura Vera Rubin.

La idea sería introducir configuraciones de cómputo híbridas que combinen GPU de NVIDIA con LPUs especializadas, permitiendo optimizar distintas etapas del procesamiento de modelos de IA. Este enfoque se alinea con el concepto de inferencia desagregada, donde diferentes tipos de aceleradores se encargan de fases concretas del pipeline de ejecución.

Algunas filtraciones sugieren que estas LPUs podrían integrarse en bandejas de cómputo con configuraciones de 64, 128 o 256 unidades, conectadas a las GPU Rubin mediante tecnologías de interconexión como NVLink Fusion. Este tipo de arquitectura permitiría distribuir el procesamiento entre diferentes tipos de aceleradores, mejorando la eficiencia en tareas como decodificación, inferencia o gestión de contexto dentro de los modelos.

Feynman: la próxima generación de chips de IA de NVIDIA

Además de las novedades relacionadas con Rubin, se espera que NVIDIA ofrezca nuevos detalles sobre Feynman, la próxima generación de su arquitectura para IA. Aunque este proyecto ya fue mencionado brevemente en GTC 2025, la edición de 2026 podría mostrar por primera vez una visión más completa de esta plataforma.

Las filtraciones apuntan a que Feynman podría fabricarse utilizando el proceso A16 de TSMC, una tecnología avanzada que permitiría aumentar significativamente la densidad de transistores y mejorar el rendimiento energético. Algunas fuentes incluso sugieren que NVIDIA podría convertirse en uno de los primeros clientes en adoptar este nodo de fabricación.

La arquitectura también podría incorporar tecnologías avanzadas de empaquetado 3D, como SoIC o soluciones de interconexión híbrida, permitiendo combinar múltiples chiplets dentro de un mismo procesador. En ese contexto, también se ha especulado con la posibilidad de integrar LPUs directamente en el encapsulado del chip, lo que reforzaría el enfoque híbrido de la plataforma.

Vera Rubin y las nuevas arquitecturas de rack NVL

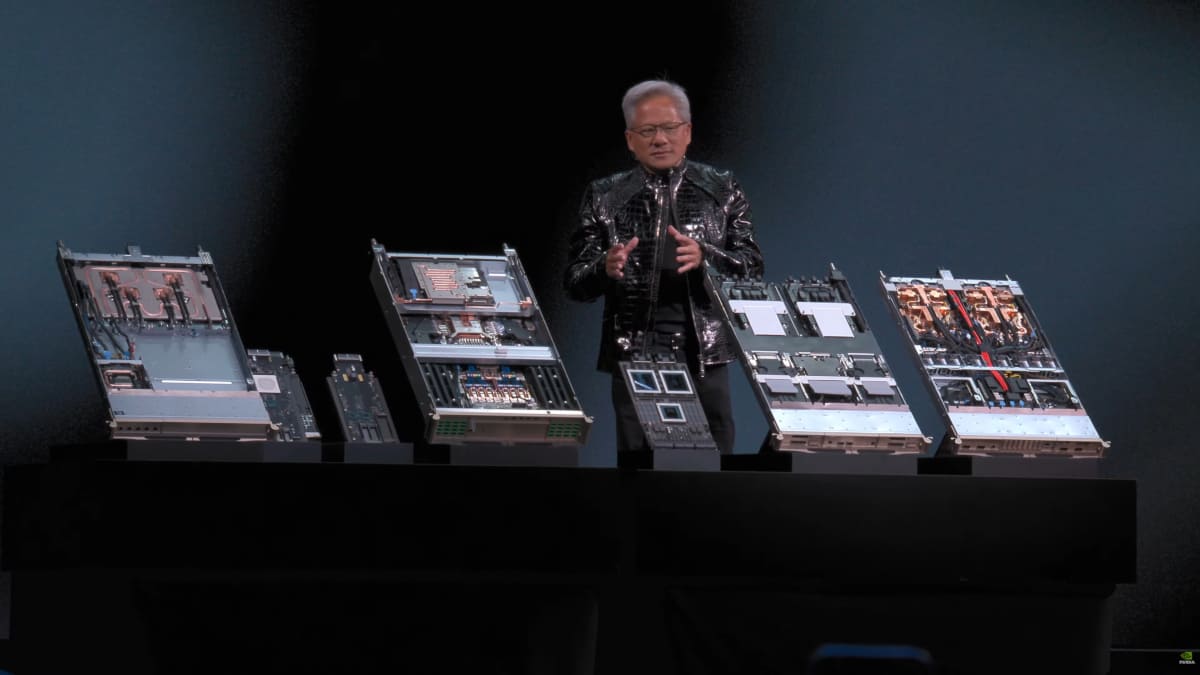

Mientras la arquitectura Feynman aún se encuentra en desarrollo, NVIDIA continúa ampliando el ecosistema de Vera Rubin, la generación de hardware de IA que actualmente lidera su hoja de ruta para centros de datos. Dentro de esta plataforma, la compañía ha presentado distintas configuraciones de infraestructura de rack, diseñadas para escalar el rendimiento de los sistemas de IA a niveles sin precedentes.

Entre ellas destaca la familia NVL, que incluye configuraciones como NVL8, NVL72 y las futuras plataformas de mayor escala. El sistema NVL72, mostrado recientemente, integra 72 chips en un único rack, aunque NVIDIA ya trabaja en configuraciones aún más ambiciosas.

Algunas filtraciones apuntan a que el objetivo final podría ser el desarrollo de racks como NVL576, capaces de integrar 576 GPU dentro de un único sistema, utilizando nuevas arquitecturas de interconexión y distribución de energía.

Infraestructura óptica y nuevos diseños de centros de datos

Para poder gestionar configuraciones de esa escala, NVIDIA también está desarrollando nuevas tecnologías de interconexión. Una de ellas es CPO (Co-Packaged Optics), una solución que sustituye parte de las conexiones eléctricas tradicionales por enlaces ópticos integrados, reduciendo la latencia y mejorando la eficiencia energética.

Este enfoque podría resultar clave para superar las limitaciones térmicas y de consumo asociadas a infraestructuras con centenares de GPU en un único rack, algo que empieza a convertirse en un desafío técnico para los centros de datos de nueva generación.

Además, NVIDIA planea adoptar nuevos sistemas de distribución eléctrica como el modelo 800 VDC de alimentación directa a rack, diseñado para soportar las enormes demandas energéticas de las plataformas de IA modernas.

GTC 2026 marcará el futuro de la computación de IA

El evento GTC 2026 comenzará el 16 de marzo, con la keynote de Jensen Huang prevista para las 11:00 AM PT. Durante esta presentación se espera que NVIDIA ofrezca una visión más detallada de su estrategia para la próxima década de infraestructura de inteligencia artificial.

Si las previsiones se cumplen, la edición de este año podría marcar el inicio de una transición importante en el sector, donde el modelo tradicional de aceleración basada exclusivamente en GPU evolucionará hacia plataformas de cómputo heterogéneo, combinando distintos tipos de aceleradores especializados.

Vía: Wccftech