El sector de los hiperescaladores continúa intensificando la carrera por desarrollar silicio propio para inteligencia artificial, y Meta ha confirmado que seguirá apostando por sus aceleradores internos dentro de la familia MTIA (Meta Training and Inference Accelerator). La compañía ha detallado una hoja de ruta muy agresiva que contempla cuatro nuevas generaciones de chips en apenas dos años, un ritmo de desarrollo que refleja la presión actual por aumentar la capacidad de cómputo para modelos de IA cada vez más grandes.

Este movimiento responde a una tendencia creciente entre grandes plataformas tecnológicas que buscan reducir su dependencia de GPUs comerciales, especialmente de fabricantes como NVIDIA. Empresas como Google o Amazon ya han demostrado que los ASIC diseñados para cargas internas pueden resultar extremadamente eficientes cuando se optimizan para tareas concretas dentro de sus centros de datos.

MTIA 300: el punto de partida para la nueva generación

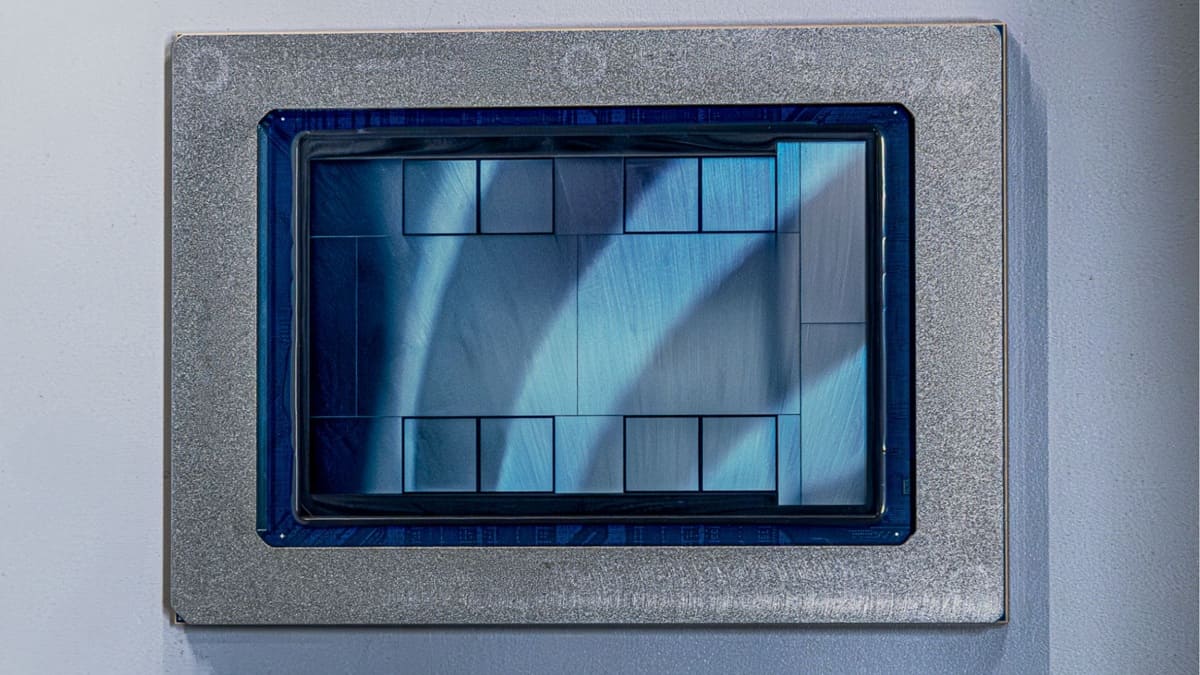

El primer paso dentro de esta estrategia lo marca el MTIA 300, un acelerador diseñado principalmente para entrenamiento en sistemas de ranking y recomendación, dos de las cargas de trabajo más habituales en plataformas sociales y servicios online. Este chip introduce una arquitectura basada en chiplets, con un diseño compuesto por un chiplet de cómputo y dos chiplets de red, acompañados por múltiples pilas de memoria HBM.

En esta configuración, el MTIA 300 ofrece 216 GB de memoria HBM con un ancho de banda total de 6,12 TB/s, además de una red de escala externa que alcanza 200 GB/s. Aunque no se trata de la solución más potente de la hoja de ruta, este modelo ha servido como base tecnológica para el desarrollo de la siguiente generación.

MTIA 400: salto notable en rendimiento

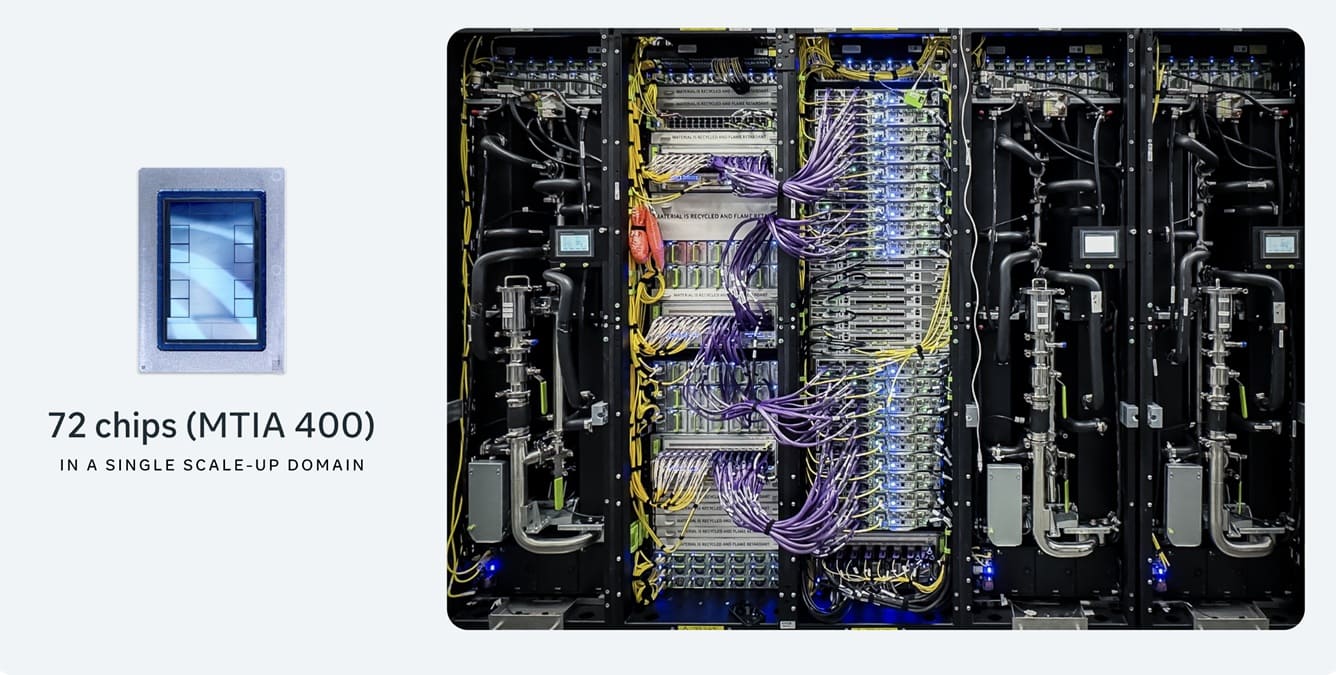

La siguiente iteración es el MTIA 400, que introduce mejoras sustanciales en potencia de cálculo y capacidad de memoria. Meta afirma que esta generación ofrece hasta un 400% más de rendimiento FP8 respecto al modelo anterior, junto con un 51% más de ancho de banda HBM, lo que la convierte en una plataforma mucho más competitiva para cargas de trabajo modernas de inteligencia artificial.

El chip también se integra dentro de una arquitectura de escala ampliada de hasta 72 aceleradores, conectados mediante un backplane conmutado que permite distribuir cargas de trabajo masivas dentro del centro de datos. Según la compañía, esta generación ya se encuentra en camino hacia su despliegue, lo que indica que el diseño ha alcanzado niveles de rendimiento considerados competitivos frente a alternativas del mercado.

MTIA 450 y MTIA 500: enfoque total en inferencia de IA

Las generaciones posteriores, MTIA 450 y MTIA 500, están diseñadas específicamente para responder a la creciente demanda de inferencia en modelos de inteligencia artificial generativa. En lugar de centrarse únicamente en potencia de cálculo, estas versiones priorizan capacidad de memoria y ancho de banda, factores críticos para ejecutar modelos de gran tamaño en producción.

El MTIA 450 eleva el ancho de banda HBM hasta 18,4 TB/s, mientras que el MTIA 500 alcanza 27,6 TB/s, acompañado por configuraciones de memoria que podrían situarse entre 384 GB y 512 GB de HBM. Además, el consumo energético del módulo también aumenta progresivamente, pasando de 800W en el MTIA 300 hasta 1.700W en el MTIA 500, reflejando la enorme demanda energética de estos sistemas.

Arquitectura modular basada en chiplets

Uno de los elementos clave que permite a Meta mantener este ritmo de desarrollo es el uso de una arquitectura modular basada en chiplets. Gracias a este enfoque, la compañía puede actualizar componentes individuales del chip sin rediseñar completamente el sistema, lo que reduce tiempos de desarrollo y facilita introducir mejoras generacionales con mayor rapidez.

Este modelo también permite adaptar cada generación a diferentes tipos de cargas de trabajo, desde entrenamiento hasta inferencia de modelos generativos. En la práctica, la modularidad se convierte en una ventaja estratégica para mantener un ciclo de innovación mucho más rápido que el de los aceleradores tradicionales.

Meta mantiene su apuesta por el silicio propio

En los últimos meses habían surgido rumores que apuntaban a una posible reducción de los esfuerzos de Meta en silicio propio tras ampliar su colaboración con NVIDIA. Sin embargo, la hoja de ruta presentada demuestra que la compañía mantiene una estrategia firme de desarrollo interno, buscando complementar -y en algunos casos sustituir- las GPUs comerciales en determinadas cargas de trabajo.

Según los planes actuales, todas las generaciones mencionadas dentro de la familia MTIA deberían desplegarse progresivamente entre 2026 y 2027, ayudando a Meta a reducir los cuellos de botella de cómputo en sus plataformas de inteligencia artificial.

Vía: Wccftech