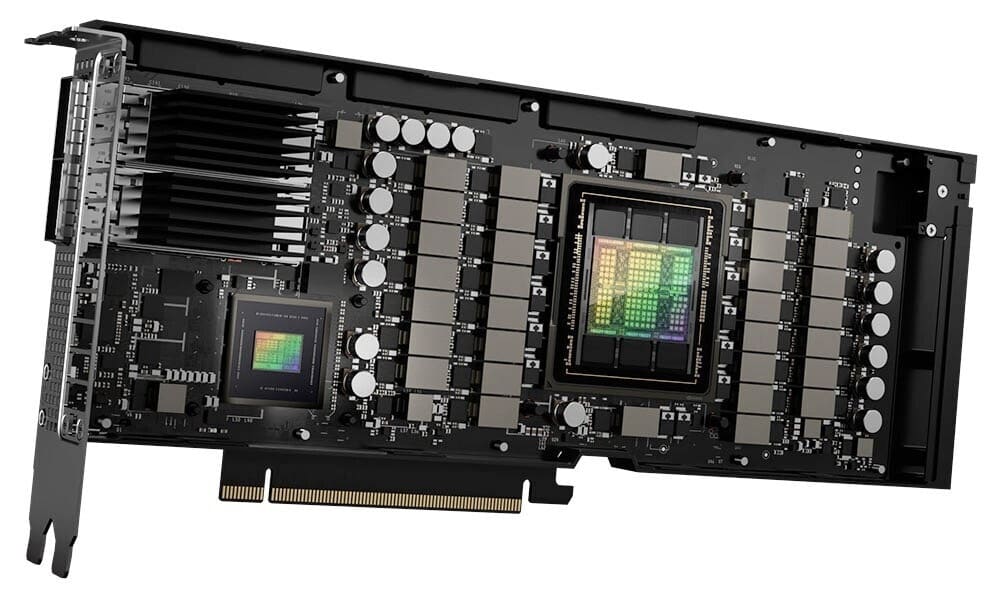

El acelerador H100 de NVIDIA destaca por ser una de las soluciones más potentes para potenciar las cargas de trabajo basadas en IA. Y, por supuesto, todas las compañías y gobiernos desean utilizarlo para impulsar su carga de trabajo de IA.

Sin embargo, en países como China, el envío de productos fabricados en Estados Unidos resulta complicado. Con las normativas de exportación en vigor, NVIDIA tuvo que ser creativa y fabricar una versión específica de su GPU H100 para el mercado chino, etiquetada como H800.

A finales del pasado año, la compañía también creó una versión específica para China del modelo A100, denominada A800, con la única diferencia de que el ancho de banda de interconexión entre chips se redujo de 600 a 400 GB/s.

El modelo H800 de este año también presenta restricciones similares, y la compañía parece haber hecho sacrificios parecidos para poder enviar sus chips a China. Del ancho de banda de 600 GB/s del modelo PCIe H100 estándar, el H800 se reduce a tan solo 300 GB/s de velocidad de interconexión bidireccional entre chips.

Aunque no disponemos de datos sobre si se ha ajustado el recuento de núcleos CUDA o Tensor, el sacrificio de ancho de banda para cumplir la normativa de exportación tendrá consecuencias. Al reducirse la velocidad de comunicación, el entrenamiento de modelos de gran tamaño incrementará la latencia y ralentizará la carga de trabajo en comparación con el chip H100 estándar. Esto se debe al enorme volumen de datos que deben transportarse de un chip a otro.

Según Reuters, un portavoz de NVIDIA declinó hablar de otras diferencias y afirmó que «nuestros productos de la serie 800 cumplen en su totalidad la normativa de control de exportaciones.»

Vía: TechPowerUp