Los resultados de MLPerf Inference v6.0 sitúan a NVIDIA en una posición dominante dentro de la inferencia de IA. Con su arquitectura Blackwell Ultra, la compañía afirma ofrecer el mayor rendimiento agregado frente a sus competidores, un dato que debe leerse con contexto, pero que refleja su ventaja actual. Lo relevante es que estos resultados proceden de entornos de despliegue con cargas reales, donde el rendimiento tiene impacto directo en costes y eficiencia operativa.

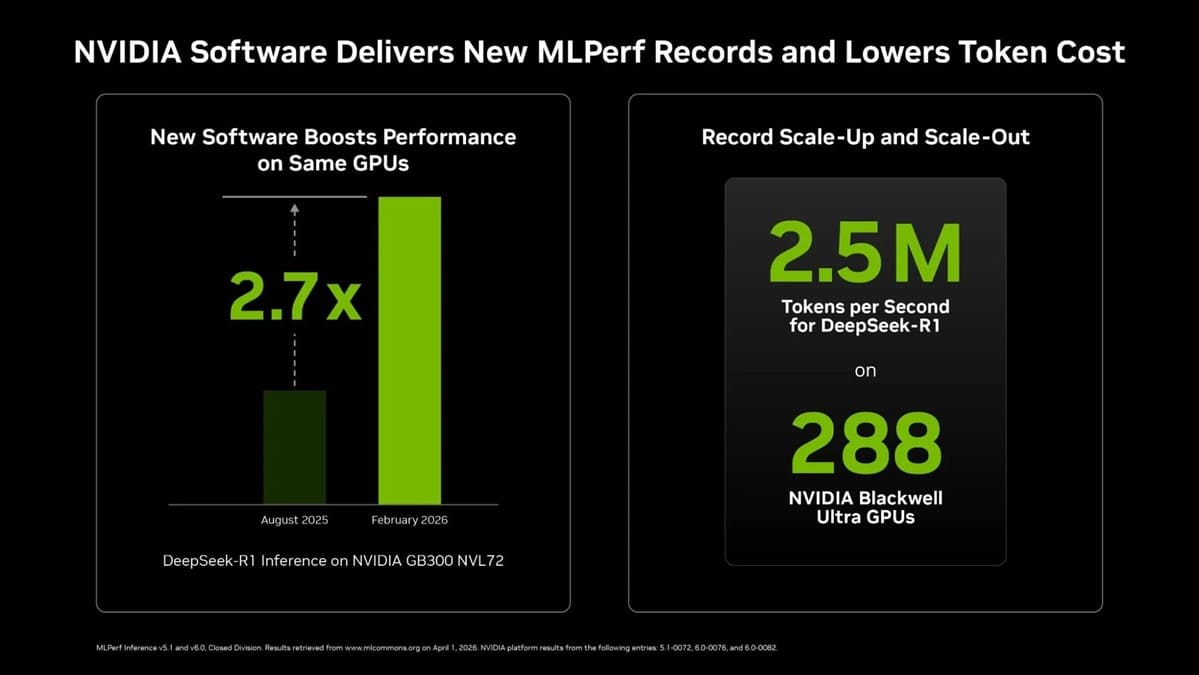

Uno de los datos más relevantes es que NVIDIA ha conseguido mejoras de hasta 2,77x en rendimiento frente a la generación anterior, manteniendo una evolución consistente entre versiones del benchmark. Este salto no depende únicamente del hardware, sino de optimización conjunta entre arquitectura, software y sistema, lo que refuerza su estrategia. En la práctica, esto implica que el rendimiento crece por eficiencia global, no solo por aumento de potencia bruta.

Blackwell Ultra y co-diseño: la base del rendimiento sostenido

El avance de NVIDIA no se explica únicamente por la GPU. La compañía aplica un enfoque de co-diseño entre hardware, software e infraestructura, optimizando cada capa del sistema de forma conjunta. Esto se traduce en mayor throughput y menor coste por token, dos métricas clave en despliegues reales de IA a gran escala.

En benchmarks como DeepSeek-R1 o Llama 3.1 405B, NVIDIA consigue aumentos claros en tokens por segundo por GPU. Estos resultados demuestran que el rendimiento depende de la integración del sistema completo, no solo de la capacidad del chip individual. Además, la consistencia entre pruebas refuerza que se trata de una ventaja estructural y no puntual.

Optimización de software: mejoras sin necesidad de nuevo hardware

Uno de los puntos más importantes es que NVIDIA ha logrado un aumento de hasta 2,7x en throughput sin cambios de hardware, únicamente mediante mejoras en software. Esto demuestra que el rendimiento en IA no depende exclusivamente del silicio, sino de cómo se optimiza el sistema completo.

En entornos empresariales, este enfoque tiene impacto directo. Poder mejorar rendimiento sin actualizar hardware implica reducir costes y aumentar eficiencia operativa, algo clave en centros de datos. Además, permite que la mejora sea progresiva, sin depender exclusivamente de nuevas generaciones de GPU.

MLPerf v6.0 amplía el foco hacia modelos más exigentes

La nueva versión del benchmark introduce soporte para modelos más avanzados como DeepSeek-R1, Mixtral 8x7B y GPT-OSS-120B, además de cargas como razonamiento, recomendadores generativos y modelos multimodales. Esto obliga a medir rendimiento en escenarios más cercanos al uso real en empresas, donde la complejidad es mayor.

Este cambio eleva el nivel de exigencia del benchmark. Ya no se trata solo de LLM clásicos, sino de cargas heterogéneas donde la eficiencia del sistema completo marca diferencias claras. En este contexto, NVIDIA no solo mantiene su rendimiento, sino que lo amplía.

Presencia constante en MLPerf y su impacto en el sector

NVIDIA destaca también por su presencia constante en MLPerf, un factor que influye directamente en su posicionamiento dentro del sector de IA. Mientras otros fabricantes participan de forma más limitada, la compañía mantiene una estrategia activa de validación en benchmarks, lo que refuerza su visibilidad y credibilidad técnica.

Este enfoque permite a NVIDIA mostrar rendimiento en escenarios comparables y medibles, algo clave en un mercado donde las cifras deben contextualizarse. No se trata solo de publicar resultados, sino de hacerlo en pruebas reconocidas que faciliten la comparación entre plataformas.

Liderazgo en benchmarks con lectura crítica de mercado

El dominio de NVIDIA en MLPerf debe interpretarse con criterio. Aunque los resultados muestran una ventaja clara, el rendimiento en benchmarks no siempre se traslada de forma directa a todas las implementaciones reales, especialmente cuando entran en juego factores como coste, consumo o eficiencia energética.

Aun así, los datos refuerzan una tendencia evidente. NVIDIA mantiene su posición gracias a integración vertical, optimización continua y control del ecosistema, tres elementos que explican su ventaja actual. Este enfoque no solo mejora el rendimiento, sino que también consolida su presencia en el mercado de IA.

Vía: Wccftech