La evolución del sector de memoria para IA apunta a un nuevo protagonista: HBF (High-Bandwidth Flash), una tecnología que busca cerrar la brecha entre HBM y NAND Flash. Sin embargo, pese a su potencial, NVIDIA no tiene previsto adoptarla a corto plazo, manteniendo su apuesta por HBM en sus plataformas actuales.

Este movimiento refleja una realidad del mercado: no todas las innovaciones se adoptan de inmediato, especialmente cuando existen alternativas maduras. Mientras tanto, otros actores como Google sí están dispuestos a explorar el potencial de esta nueva memoria.

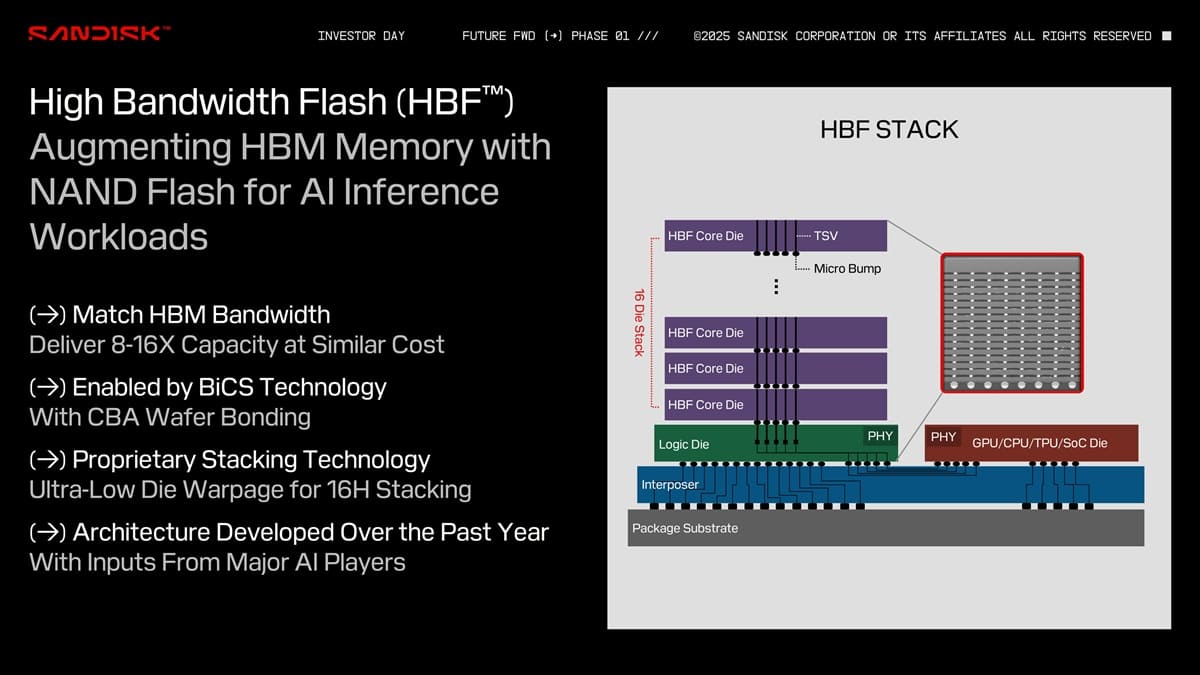

HBF: arquitectura apilada para escalar capacidad hasta 4 TB

La memoria HBF está siendo desarrollada por SanDisk y SK hynix, y adopta un diseño inspirado en HBM basado en apilamiento de múltiples capas de NAND Flash conectadas mediante TSV (Through Silicon Vias).

Este enfoque permite integrar múltiples capas en un solo bloque, alcanzando capacidades de hasta 4 TB por stack, muy por encima de los 32–64 GB típicos de HBM. La clave aquí no es solo la capacidad, sino la posibilidad de compactar memoria en un espacio reducido, algo crítico en sistemas de IA.

NAND related update:

NVIDIA still does not appear interested in HBF. Its view is that HBF’s high bandwidth can be sufficiently addressed with eSSDs.

There were recent reports that SanDisk had issued POs related to HBF, and the customer SanDisk is believed to be in discussions…

— Jukan (@jukan05) April 28, 2026

Menor velocidad que HBM, pero suficiente para inferencia

A nivel de rendimiento, HBM sigue siendo superior en ancho de banda, pero HBF no busca competir directamente en ese terreno. Su objetivo es ofrecer un equilibrio entre capacidad, consumo y throughput, suficiente para tareas concretas.

Este enfoque la hace especialmente interesante para cargas de inferencia, donde la capacidad y la gestión de datos pesan más que la latencia pura. En este contexto, HBF puede aliviar limitaciones como el KV cache, que actualmente depende en gran medida de la memoria principal.

NVIDIA prioriza HBM y apuesta por SSDs de nueva generación

A pesar del potencial de HBF, NVIDIA no planea adoptarla en el corto plazo. La compañía considera que las limitaciones actuales pueden resolverse mediante eSSD de alta velocidad, en lugar de cambiar de arquitectura de memoria.

En esta línea, trabaja junto a Kioxia en el desarrollo de SSD PCIe Gen7, con velocidades que podrían ser hasta 100× superiores a las actuales. Esta estrategia refuerza su apuesta por soluciones ya integradas en su ecosistema.

Google se posiciona como principal impulsor de HBF

Mientras NVIDIA se mantiene al margen, Google aparece como uno de los principales interesados en HBF. La compañía planea integrar esta tecnología en su ecosistema de TPU, que sigue creciendo a gran velocidad.

El objetivo es claro: disponer de más capacidad de memoria por nodo, algo crítico en entornos de IA a gran escala. En este contexto, HBF encaja como una solución complementaria para soportar cargas masivas de datos.

Alternativa a DDR y LPDDR en servidores de IA

Más allá de competir con HBM, HBF podría tener otro papel relevante: sustituir memoria tradicional como DDR o LPDDR5/LPDDR5X en servidores de IA.

El diseño apilado permite reducir el espacio en placa, mejorar la eficiencia energética y aumentar la capacidad total. Esto resulta especialmente útil en un escenario donde la CPU se está convirtiendo en cuello de botella, impulsando la necesidad de más memoria cercana al procesamiento.

Primeras muestras en camino, pero adopción aún incierta

SK hynix lidera el desarrollo y espera lanzar las primeras muestras de HBF en la segunda mitad de este año, marcando el inicio de su despliegue real.

Aun así, su adopción dependerá de múltiples factores, desde el coste hasta la integración en plataformas existentes. HBF no reemplazará a HBM de forma inmediata, pero sí apunta a convertirse en una pieza clave dentro del ecosistema de memoria para IA.

Vía: Wccftech