El avance de la IA local está dando lugar a soluciones cada vez más compactas, y Unigen ha presentado una propuesta especialmente interesante con su módulo Amaretti E1.S, capaz de integrar aceleración de inteligencia artificial en un formato similar a un SSD M.2 tradicional. Este enfoque busca aprovechar el hardware existente en equipos convencionales.

La clave está en combinar alto rendimiento en IA con un consumo muy contenido. En este caso, el módulo ofrece hasta 60 TOPS de potencia de cálculo, lo que lo sitúa como una opción viable para ejecutar modelos de IA directamente en el dispositivo, sin depender de la nube.

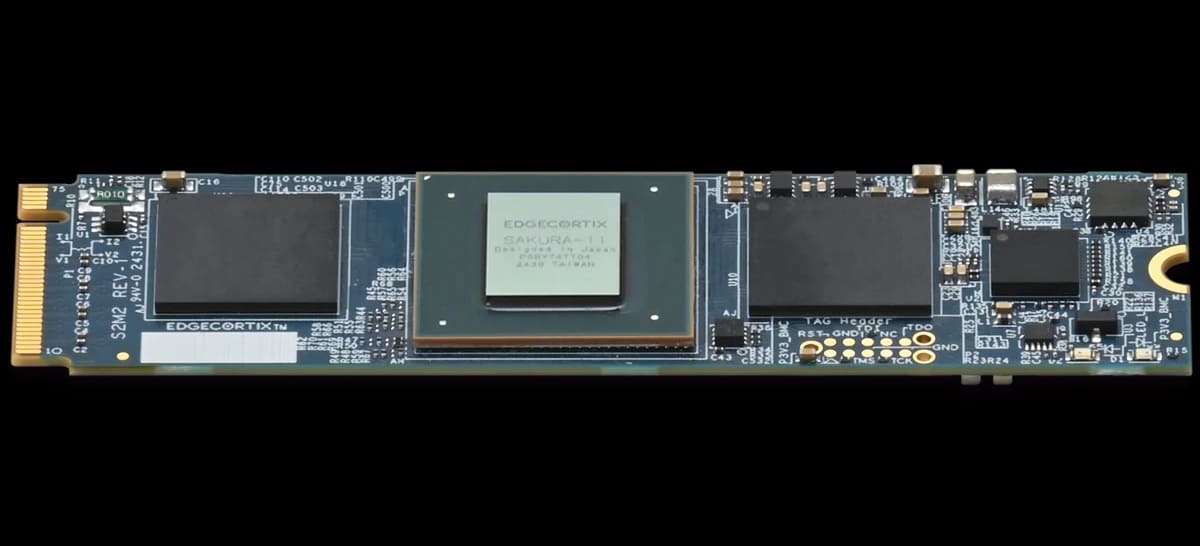

Un acelerador SAKURA-II en formato compacto y eficiente

El corazón del módulo es el acelerador SAKURA-II de EdgeCortix, diseñado para plataformas de bajo consumo y ahora adaptado a un formato más versátil. Este chip integra una NPU con 60 TOPS en INT8 y alcanza 30 TFLOPS en BF16, ofreciendo un equilibrio interesante entre rendimiento y eficiencia.

A nivel de arquitectura, incluye un controlador LPDDR4x de doble canal de 64 bits y un total de 20 MB de caché SRAM integrada, lo que permite reducir latencias en cargas de trabajo intensivas. Todo ello se encapsula en un formato compacto que mantiene un consumo real de entre 8W y 10W, clave para entornos limitados térmicamente.

Unigen ha llevado este diseño a una placa E1.S compatible con M.2, añadiendo configuraciones de hasta 32 GB de memoria, disponibles también en variantes de 16 GB, con un ancho de banda que alcanza los 68 GB/s.

Capaz de ejecutar modelos de hasta 20B parámetros en local

Uno de los puntos más relevantes del módulo es su capacidad para ejecutar modelos de lenguaje de hasta 20.000 millones de parámetros (20B) gracias a su configuración de memoria. Esto lo posiciona como una solución válida para tareas de GenAI y flujos de trabajo basados en IA agente (Agentic AI) sin depender de servidores externos.

Este tipo de soluciones resulta especialmente útil en escenarios donde la latencia, la privacidad de datos o la conectividad son factores críticos. Poder ejecutar modelos directamente en el dispositivo abre nuevas posibilidades en entornos edge o incluso en equipos personales.

Además, el diseño permite instalar múltiples módulos en distintos slots M.2, lo que facilita escalar el rendimiento de forma modular, algo poco habitual en este tipo de soluciones compactas.

Compatibilidad con frameworks de IA y enfoque práctico

El módulo de Unigen es compatible con los principales frameworks del sector, incluyendo TensorFlow, PyTorch, ONNX y Hugging Face, lo que simplifica su integración en entornos de desarrollo actuales y reduce las barreras de adopción.

Entre sus características más destacadas se incluyen soporte para inferencia avanzada, capacidad de integrarse en servidores de bajo consumo y un enfoque orientado a reducir el consumo energético frente a soluciones basadas en GPU, especialmente en tareas específicas de IA.

Otro punto relevante es su tiempo de entrega estimado de 14 semanas, inferior al habitual en servidores con GPU, lo que podría convertirlo en una alternativa interesante en determinados escenarios donde la disponibilidad es un factor clave.

Una alternativa real para llevar la IA al PC y edge computing

El enfoque de este módulo responde a una realidad clara: muchos equipos cuentan con slots M.2 sin uso, especialmente en sobremesas y portátiles. Aprovechar este espacio para añadir capacidades de IA puede resultar más eficiente que depender de soluciones externas o hardware dedicado adicional.

Frente a configuraciones PCIe más complejas, este formato ofrece una entrada más accesible al mundo de la aceleración de IA local, con un consumo contenido y una integración sencilla. Aun así, su rendimiento estará condicionado por el tipo de carga y el software utilizado.

En conjunto, el Unigen Amaretti plantea una alternativa interesante dentro del ecosistema de IA en el edge, donde el equilibrio entre consumo, tamaño y rendimiento será cada vez más importante en los próximos años.

Vía: Wccftech