Tras presentar la arquitectura Vera Rubin como su próxima generación de infraestructura para inteligencia artificial, NVIDIA ha confirmado un nuevo hito dentro de su hoja de ruta industrial: el envío de las primeras unidades Vera Rubin VR200 a clientes en forma de muestras iniciales. El anuncio se produjo durante la presentación de resultados financieros de 2025, donde la compañía detalló avances clave en la transición hacia sistemas de computación acelerada a escala rack orientados a modelos de IA de nueva generación.

El inicio del envío de muestras VR200 confirma la entrada de Vera Rubin en fase de validación real por parte de clientes, un paso fundamental antes del despliegue comercial. Según la compañía, los envíos en volumen comenzarán durante la segunda mitad de 2026, consolidando la transición desde la arquitectura Blackwell hacia una plataforma diseñada específicamente para cargas de entrenamiento e inferencia masiva.

Una arquitectura completa que busca reducir el coste de la inferencia hasta diez veces

La plataforma Vera Rubin integra múltiples componentes dentro de un único ecosistema optimizado, combinando la CPU Vera, la GPU Rubin, el conmutador NVLink 6, la interfaz de red ConnectX-9 SuperNIC, la DPU BlueField-4 y el switch Spectrum-6 Ethernet. Esta integración a nivel de sistema permite tratar el rack completo como una única unidad de cómputo, reduciendo latencias internas y mejorando la eficiencia energética global.

Según NVIDIA, la nueva plataforma permitirá ejecutar modelos de IA de escala trillón de parámetros utilizando aproximadamente una cuarta parte de las GPU necesarias en Blackwell, lo que se traduciría en una reducción de costes de inferencia de hasta diez veces. El diseño adopta además una arquitectura modular sin cables basada en bandejas intercambiables, pensada para mejorar la resiliencia, la facilidad de mantenimiento y la continuidad operativa en centros de datos hyperscale.

Este enfoque marca un cambio hacia infraestructuras donde la eficiencia del sistema completo importa más que el rendimiento aislado de una GPU individual, reforzando la tendencia hacia plataformas rack-scale totalmente integradas.

GPU Rubin con hasta 100 PetaFLOPS FP4 y memoria HBM4 masiva

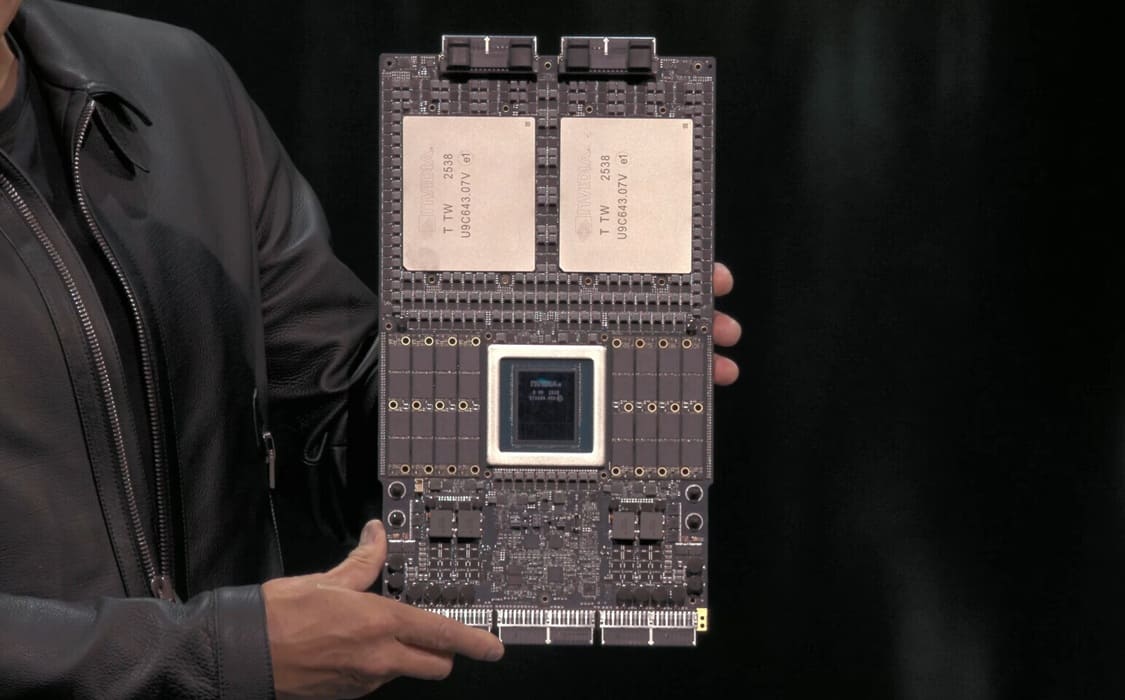

Los sistemas VR200 representan la propuesta más potente de NVIDIA hasta la fecha dentro del diseño de infraestructuras de IA. Cada GPU Rubin ofrece hasta 50 PetaFLOPS de rendimiento FP4, alcanzando aproximadamente 100 PetaFLOPS FP4 cuando se configura el Superchip de doble GPU.

El silicio integra dos chiplets de computación de tamaño retícula completa junto a ocho pilas de memoria HBM4, proporcionando 288 GB de memoria HBM4 por GPU y cerca de 576 GB de HBM4 por Superchip. La enorme capacidad de memoria permite mantener modelos de gran tamaño residentes directamente en el acelerador, reduciendo transferencias externas y minimizando cuellos de botella en inferencia.

La combinación de cómputo FP4 de alta densidad y memoria HBM4 de gran capacidad apunta directamente a cargas de IA generativa y modelos multimodales, donde el movimiento de datos se convierte en el principal límite de rendimiento.

CPU Vera con 88 núcleos Arm y hasta 1,5 TB de memoria LPDDR5X

El sistema se completa con la nueva CPU Vera, basada en 88 núcleos Armv9.2 personalizados “Olympus”, capaces de manejar hasta 172 hilos de ejecución simultánea dentro del formato SOCAMM. Esta configuración permite integrar hasta 1,5 TB de memoria LPDDR5X a nivel de sistema, proporcionando ancho de banda suficiente para alimentar cargas de IA distribuidas.

La integración estrecha entre CPU, GPU, red y aceleradores especializados transforma el rack en una plataforma unificada de procesamiento, eliminando gran parte de las ineficiencias tradicionales entre nodos independientes. Este diseño responde al crecimiento del software de IA, donde la coordinación entre subsistemas resulta tan importante como la potencia bruta.

Este enfoque permite ejecutar cargas de IA directamente en el sistema, reduciendo latencias y dependencia de servicios en la nube, una tendencia cada vez más relevante dentro del mercado del centro de datos y del ecosistema de computación acelerada.

Vera Rubin marca el paso hacia la infraestructura de IA de próxima generación

El inicio del envío de muestras Vera Rubin VR200 confirma que NVIDIA avanza según calendario hacia una nueva generación de plataformas diseñadas específicamente para modelos cada vez más grandes y complejos. La evolución ya no se centra únicamente en aumentar la potencia de cálculo, sino en optimizar la infraestructura completa desde el silicio hasta el rack.

Con la producción prevista para la segunda mitad de 2026, Vera Rubin se perfila como la base tecnológica sobre la que se construirán las próximas infraestructuras de IA a gran escala, consolidando el paso hacia sistemas donde integración, eficiencia energética y escalabilidad se convierten en los factores determinantes del rendimiento real.

Vía: TechPowerUp