El fabricante chino amplía su estrategia de hardware con los nuevos Baidu M100 y Baidu M300, dos procesadores de IA creados por su división Kunlunxin Technology y orientados a cargas de inferencia y entrenamiento a gran escala. El M100, optimizado para inferencia, llegará a principios de 2026, mientras que el M300, diseñado para modelos multimodales con billones de parámetros, se espera para 2027. Ambos buscan reforzar la autonomía tecnológica del país en un contexto donde la dependencia de NVIDIA sigue siendo un factor crítico.

La compañía completa esta estrategia con nuevos sistemas informáticos de gran escala, incluyendo clústeres tipo “supernode” capaces de combinar cientos de procesadores propios. Entre ellos, destacan los sistemas Tianchi256 y Tianchi512, basados en los chips P800 de Baidu, previstos para 2026. Esta hoja de ruta se alinea con otros desarrollos locales como la arquitectura CloudMatrix 384 de Huawei, configurada sobre procesadores Ascend 910C.

M100 y M300: procesadores para inferencia y entrenamiento multimodal masivo

El Baidu M100 se enfocará en cargas de inferencia, uno de los segmentos con mayor crecimiento dentro de la industria de la IA. Su diseño busca reducir costes por operación y mejorar la eficiencia energética en centros de datos que despliegan modelos de gran tamaño. Por su parte, el Baidu M300 apunta directamente al entrenamiento de modelos multimodales con trillones de parámetros, un umbral donde la demanda de memoria, ancho de banda y computación especializada aumenta de forma exponencial.

Ambos chips se posicionan como alternativas domésticas frente a soluciones como las GPU NVIDIA H100 o NVIDIA H200, reforzando la tendencia del mercado chino hacia configuraciones con hardware propio. Según Baidu, estos procesadores buscan ofrecer “potencia de cálculo controlable y de bajo coste”, un mensaje alineado con la necesidad de reducir dependencia de tecnologías externas en sectores estratégicos.

Supernodos Tianchi256 y Tianchi512: nuevos clústeres con procesadores propios

La compañía también ha presentado dos sistemas de computación a gran escala: Tianchi256 y Tianchi512, integrados con 256 y 512 chips P800, respectivamente. El fabricante afirma que estas configuraciones ofrecen un rendimiento superior al 50% respecto a la generación anterior y prevé escalar esta arquitectura hasta alcanzar “millones de chips” para 2030. Estos supernodos buscan competir con plataformas globales y reducir el coste de entrenar modelos avanzados dentro del país.

Este enfoque recuerda al sistema CloudMatrix 384 de Huawei, configurado alrededor de los chips Ascend 910C, mostrando una tendencia común entre fabricantes chinos a desarrollar infraestructura propia que permita sortear limitaciones comerciales y acelerar proyectos de IA sin depender del ecosistema de GPU de NVIDIA.

Ernie 5.0: nuevo modelo multimodal con 2,4 billones de parámetros

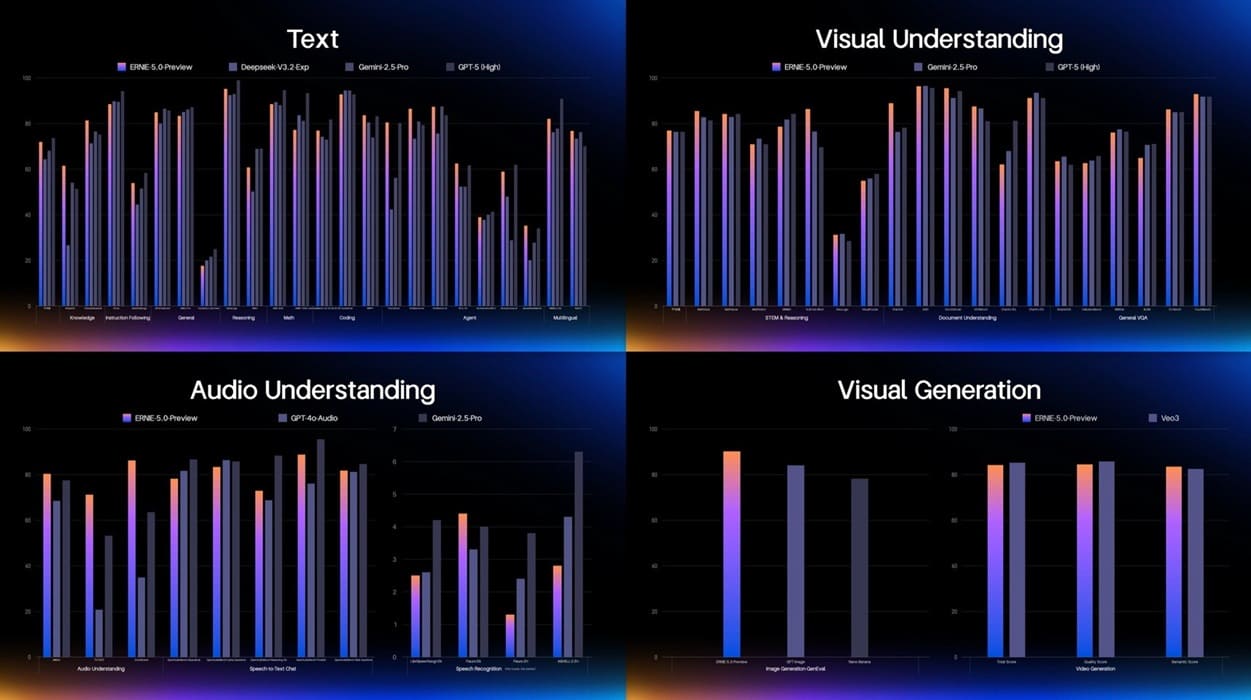

Junto al hardware, Baidu anunció Ernie 5.0, un modelo multimodal de 2,4 billones de parámetros, el doble del tamaño de alternativas como Alibaba Qwen3-Max o Moonshot Kimi K2. Su entrenamiento unificado cubre texto, imagen, vídeo, código y agentes, buscando mejorar consistencia y rendimiento en entornos donde diferentes modalidades requieren procesamiento conjunto. La compañía insiste en que la industria debe “invertir más en aplicaciones reales” y no concentrar el valor solo en chips y modelos base.

Vía: TechPowerUp