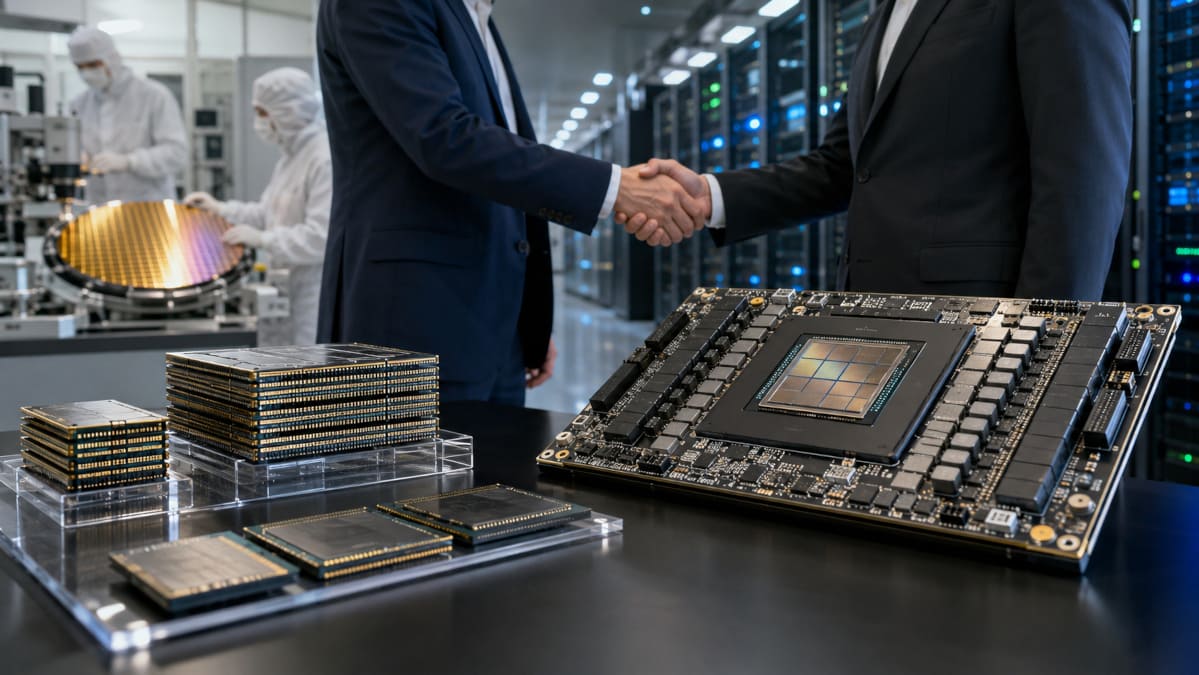

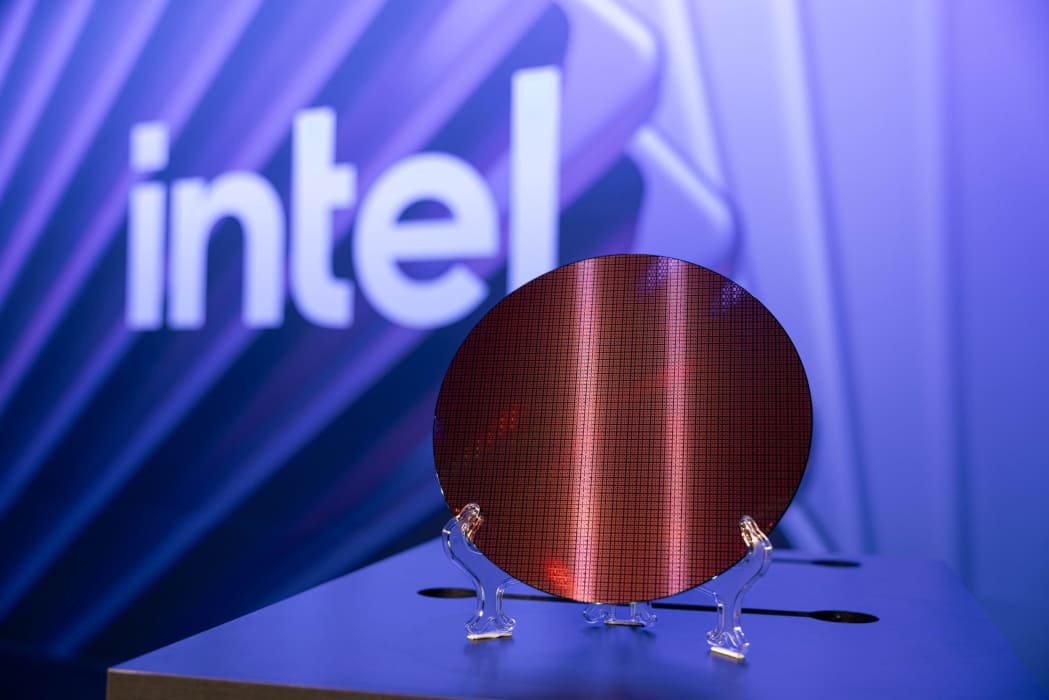

Intel podría empaquetar los TPU de Google, pero JPMorgan duda que fabrique los chips frente a TSMC

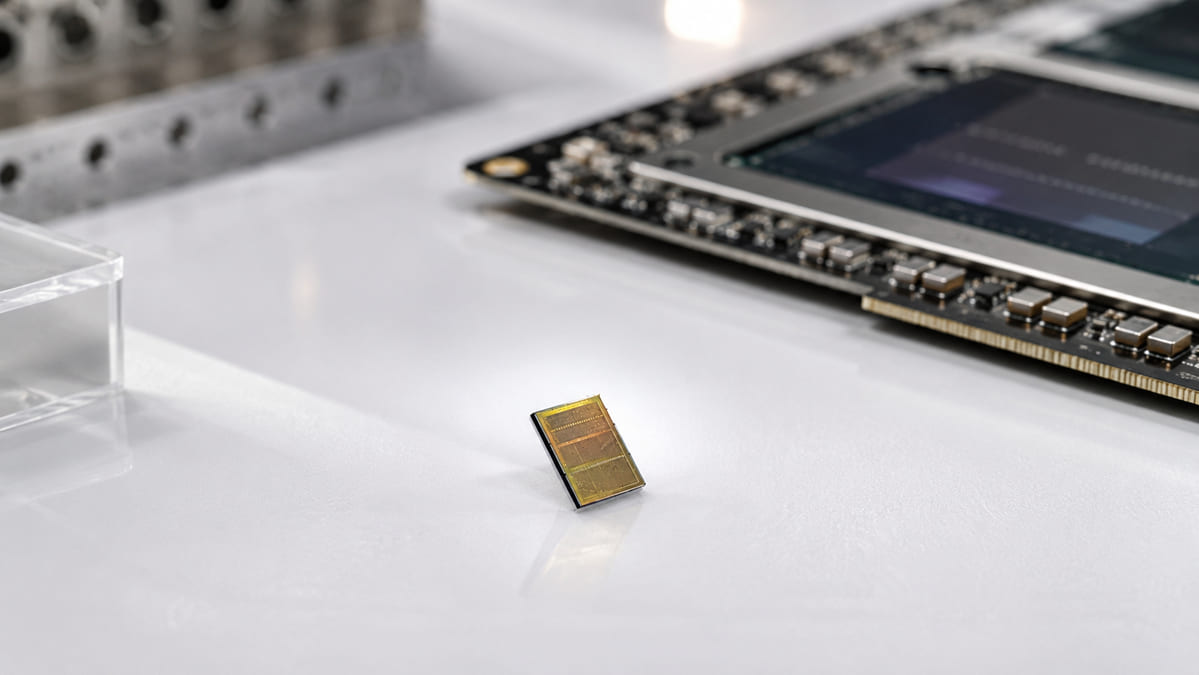

Intel vuelve a aparecer en el centro de los rumores sobre la cadena de suministro de IA, esta vez por una posible colaboración con Google en sus chips personalizados TPU. Un informe reciente apuntaba a que la compañía habría recibido un pedido para fabricar 3 millones de chips, pero los análisis de Citi y JPMorgan … Intel podría empaquetar los TPU de Google, pero JPMorgan duda que fabrique los chips frente a TSMC