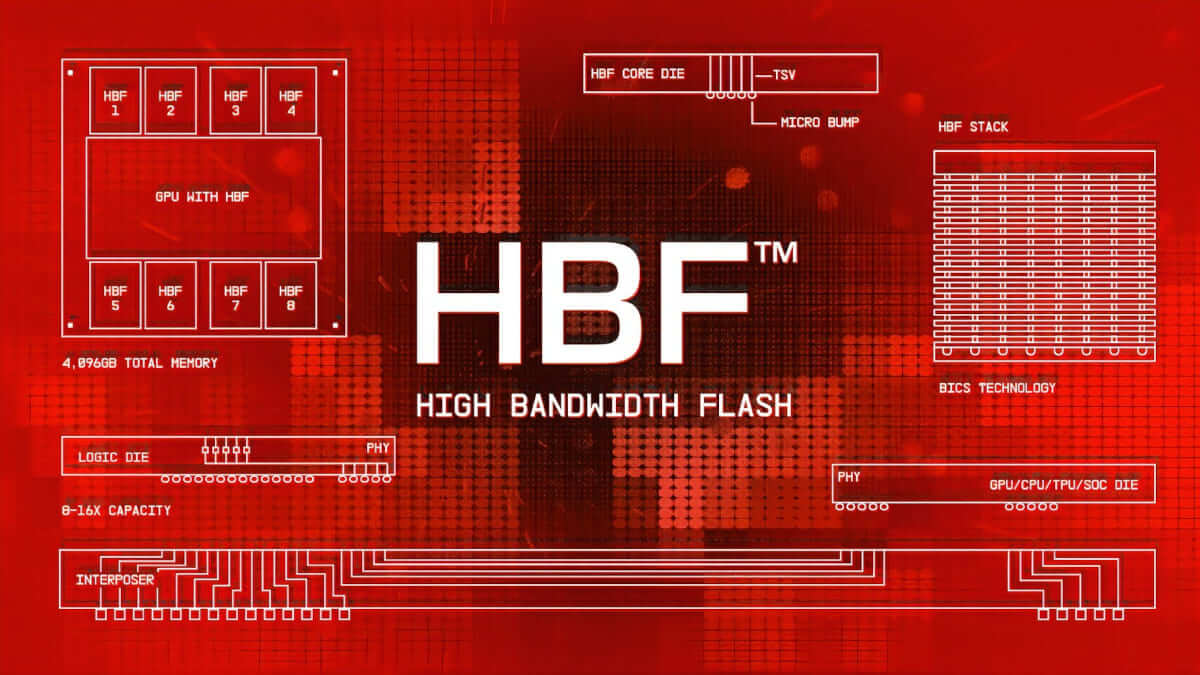

El sector de la memoria para infraestructura de inteligencia artificial continúa evolucionando hacia arquitecturas cada vez más especializadas, y en este contexto SK hynix y Sandisk han iniciado el proceso de estandarización de HBF (High Bandwidth Flash), una tecnología concebida para cubrir el espacio existente entre la memoria HBM y el almacenamiento basado en SSD. La iniciativa marca un nuevo paso dentro de la transición del sector hacia sistemas optimizados para la inferencia de IA, donde la eficiencia y la escalabilidad empiezan a ser tan importantes como el rendimiento bruto.

El anuncio refleja un cambio estructural en la industria: el foco ya no está únicamente en entrenar modelos, sino en ejecutar servicios de IA a gran escala, lo que exige nuevas soluciones capaces de gestionar grandes volúmenes de datos, mantener consumos energéticos contenidos y ofrecer latencias más equilibradas dentro de los centros de datos.

La inferencia en IA impulsa una nueva jerarquía de memoria

El mercado está pasando progresivamente del entrenamiento de Large Language Models (LLM) hacia la fase de inferencia, donde millones de consultas simultáneas requieren acceso constante a datos. Este escenario pone en evidencia las limitaciones de las arquitecturas actuales, que deben elegir entre el alto ancho de banda de la HBM o la gran capacidad de almacenamiento de los SSD.

La propuesta de HBF consiste en introducir una capa intermedia dentro de la jerarquía de memoria, diseñada para combinar mayor capacidad efectiva, mejor eficiencia energética y accesos más rápidos que el almacenamiento tradicional. En esta estructura, la HBM continúa gestionando las cargas críticas de alto rendimiento, mientras que HBF amplía la memoria disponible para inferencia sin aumentar de forma desproporcionada el consumo energético.

Este enfoque responde directamente a uno de los principales retos actuales de la IA: mantener la escalabilidad del servicio sin multiplicar los costes operativos de la infraestructura.

Escalabilidad y reducción de costes en centros de datos de IA

Uno de los objetivos técnicos asociados a HBF es reducir el Total Cost of Ownership (TCO) en plataformas de inteligencia artificial. Al introducir una capa de memoria adicional entre HBM y almacenamiento, los operadores podrían diseñar sistemas más equilibrados, evitando depender exclusivamente de memorias de alto coste por gigabyte.

Las previsiones del sector apuntan a que la demanda de arquitecturas de memoria híbridas, capaces de combinar HBM, HBF y memoria NAND, comenzará a crecer con fuerza alrededor de 2030, coincidiendo con la expansión masiva de servicios de IA generativa y asistentes inteligentes desplegados en entornos empresariales y de consumo.

En este escenario, la competitividad ya no dependerá únicamente del rendimiento individual de CPU o GPU, sino de la optimización conjunta entre procesador, aceleradores y subsistema de memoria, un factor cada vez más determinante en infraestructuras de gran escala.

Estandarización para acelerar la adopción industrial

Como parte del proceso, ambas compañías trabajarán dentro del marco del Open Compute Project (OCP) para avanzar en la definición técnica de HBF y facilitar su adopción dentro del ecosistema de hardware para centros de datos. La experiencia acumulada en diseño, encapsulado y producción masiva de memoria HBM y NAND permitirá acelerar el desarrollo de esta nueva categoría de memoria.

La evolución del sector de IA apunta a que el rendimiento ya no dependerá exclusivamente de la potencia de CPU o GPU, sino del equilibrio entre procesamiento, memoria y eficiencia energética. En ese contexto, soluciones intermedias como HBF podrían convertirse en un elemento clave para escalar infraestructuras de inferencia sin disparar consumo ni costes operativos, marcando un posible cambio en la arquitectura de los centros de datos durante la próxima década.

Vía: TechPowerUp