Intel y SoftBank, a través de su filial conjunta Saimemory, presentarán en VLSI 2026 su nueva tecnología de memoria HB3DM, basada en Z-Angle Memory (ZAM). El concepto hace referencia al apilamiento vertical de dies en el eje Z, similar a HBM convencional, pero con resultados técnicos superiores en ancho de banda.

La presentación llega cuando la demanda de memoria de alto ancho de banda para aceleradores de IA supera la capacidad disponible. Los datos preliminares de HB3DM apuntan a una propuesta que merece atención seria como alternativa real a HBM en determinados perfiles de uso.

Arquitectura de nueve capas con bonding híbrido

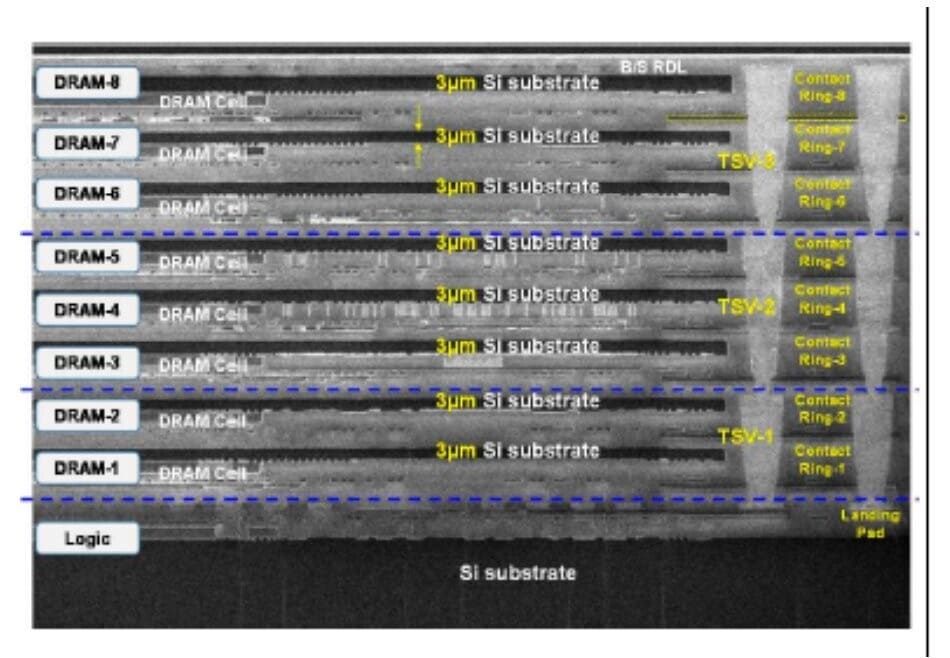

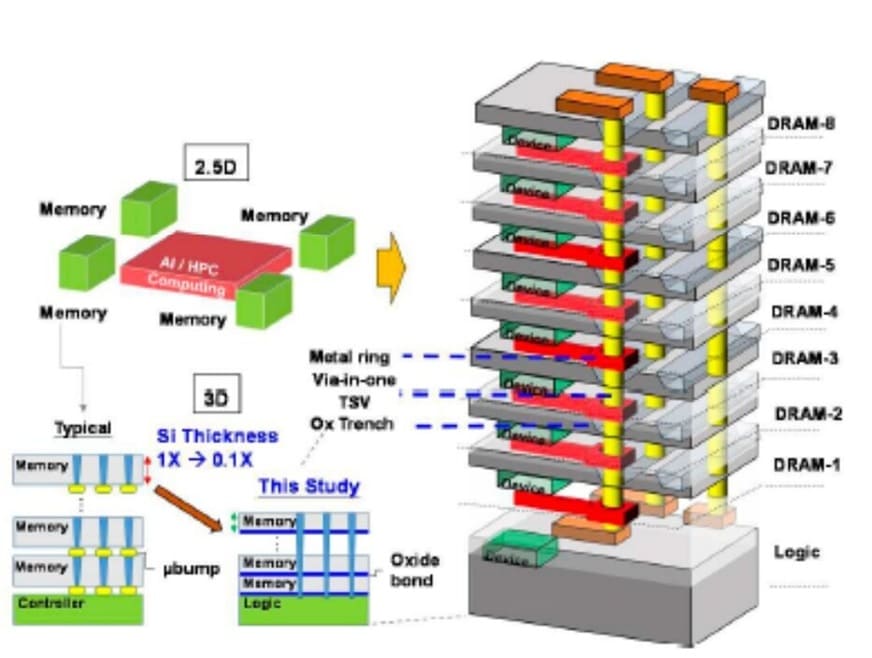

La primera generación de HB3DM apila nueve capas mediante bonding híbrido para colocación de chips en 3D. La base es una capa lógica que gestiona el movimiento de datos, sobre la que se sitúan ocho capas de DRAM con aproximadamente 13.700 TSV por capa para el bonding.

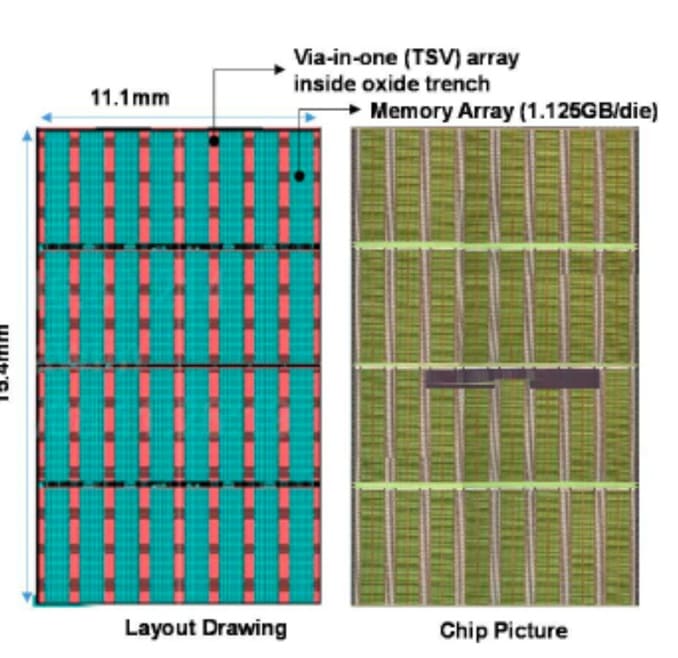

La capacidad por capa es de aproximadamente 1,125 GB, resultando en 10 GB por módulo. El diseño no está optimizado para capacidad, sino para densidad de ancho de banda por área, donde los resultados son considerablemente más llamativos que los de cualquier solución HBM disponible en la actualidad.

5,3 TB/s por módulo: el dato que redefine el debate

El ancho de banda de 0,25 Tb/s por mm² se traduce en 5,3 TB/s por módulo para un die de 171 mm². Frente a los 2 TB/s por stack de HBM4, HB3DM ofrece más del doble de ancho de banda en el mismo formato de módulo.

En inferencia y entrenamiento de IA, el ancho de banda de memoria es con frecuencia el cuello de botella real del sistema. Mover datos al doble de velocidad que HBM4 puede desbloquear mejoras de rendimiento que no serían posibles aumentando únicamente los núcleos de cómputo disponibles.

La apuesta de Saimemory es clara: no competir en capacidad bruta, sino en velocidad de transferencia de datos, el parámetro que más limita el rendimiento de los grandes aceleradores de IA. Es una lectura diferente del problema y técnicamente coherente con las tendencias actuales del sector.

La limitación de capacidad: el obstáculo que Intel debe resolver

Con 10 GB por módulo, HB3DM queda muy por debajo de los 48 GB por stack de HBM4. Para modelos de lenguaje de gran escala que necesitan almacenar cientos de gigabytes de parámetros, esa limitación es un obstáculo real que el ancho de banda no compensa por sí solo.

Intel podría aumentar capas en versiones futuras, pero la arquitectura actual de nueve capas establece un techo no trivial. La primera generación se perfila como solución para cargas donde el ancho de banda supera en importancia a la capacidad bruta disponible por módulo.

Eso define el perfil de cliente inicial. Los sistemas de inferencia en tiempo real con modelos de tamaño moderado se beneficiarían del ancho de banda de HB3DM, mientras que el entrenamiento de modelos de gran escala seguirá dependiendo de soluciones con mayor capacidad por módulo.

Sin fecha ni fabricante de DRAM confirmados

Ni Intel ni SoftBank han confirmado cuándo llegará HB3DM al mercado ni quién fabricará el DRAM subyacente. La participación de Intel abre la posibilidad de retomar la fabricación de DRAM en sus propias plantas, aunque el nodo de producción sigue sin desvelarse.

Una tecnología con resultados extraordinarios en papel puede tardar años en llegar a producción en masa sin el proceso de fabricación resuelto. La presentación en VLSI 2026 generará más información, pero las preguntas sobre viabilidad productiva y calendario comercial seguirán abiertas tras el simposio.

HB3DM como reposicionamiento estratégico de Intel en IA

Intel lleva años perdiendo terreno en aceleradores de IA frente a NVIDIA. Su apuesta por una tecnología de memoria que supera a HBM4 en ancho de banda señaliza un reposicionamiento desde la memoria y el empaquetado avanzado como vía de entrada al ecosistema de IA de próxima generación.

Si Saimemory llega a producción en masa con un calendario competitivo, Intel tendría un argumento diferenciador real en un segmento donde hasta ahora ha estado ausente. No como fabricante de aceleradores, sino como proveedor de infraestructura de memoria de alto rendimiento para sistemas de IA.

La ausencia de detalles productivos y lo que revela sobre el proyecto

Presentar una tecnología en un simposio académico sin confirmar fabricante ni calendario es habitual en semiconductores, pero también indica que el proyecto está en fase avanzada, pero no definitiva. Intel y SoftBank buscan validación técnica antes de comprometer recursos productivos a gran escala.

Generar interés en HB3DM ahora, aunque la producción esté lejos, permite a Saimemory estar en las conversaciones de planificación de los próximos ciclos de hardware. Los grandes clientes de aceleradores de IA toman decisiones de infraestructura con años de antelación, y ese es el plazo que importa.

Vía: TechPowerUp