El Instinct MI325X de AMD, lanzado en el segundo trimestre de 2025, llegó nueve meses después del lanzamiento de la NVIDIA H200 y casi de manera simultánea con la producción masiva de la arquitectura Blackwell. Este desfase temporal resultó ser desafortunado, ya que muchos compradores se decantaron por las opciones de NVIDIA Blackwell, que ofrecían una mejor relación rendimiento-precio.

Aunque hubo un interés inicial de Microsoft en 2024, no se tradujo en un compromiso continuo. Después de realizar algunas compras iniciales, Microsoft no realizó nuevos pedidos, lo que obligó a AMD a ajustar sus expectativas de márgenes para atraer a otros grandes clientes. Aunque Oracle y algunos hiperescaladores han mostrado un interés renovado, las compras realizadas siguen siendo modestas en comparación con el volumen de NVIDIA.

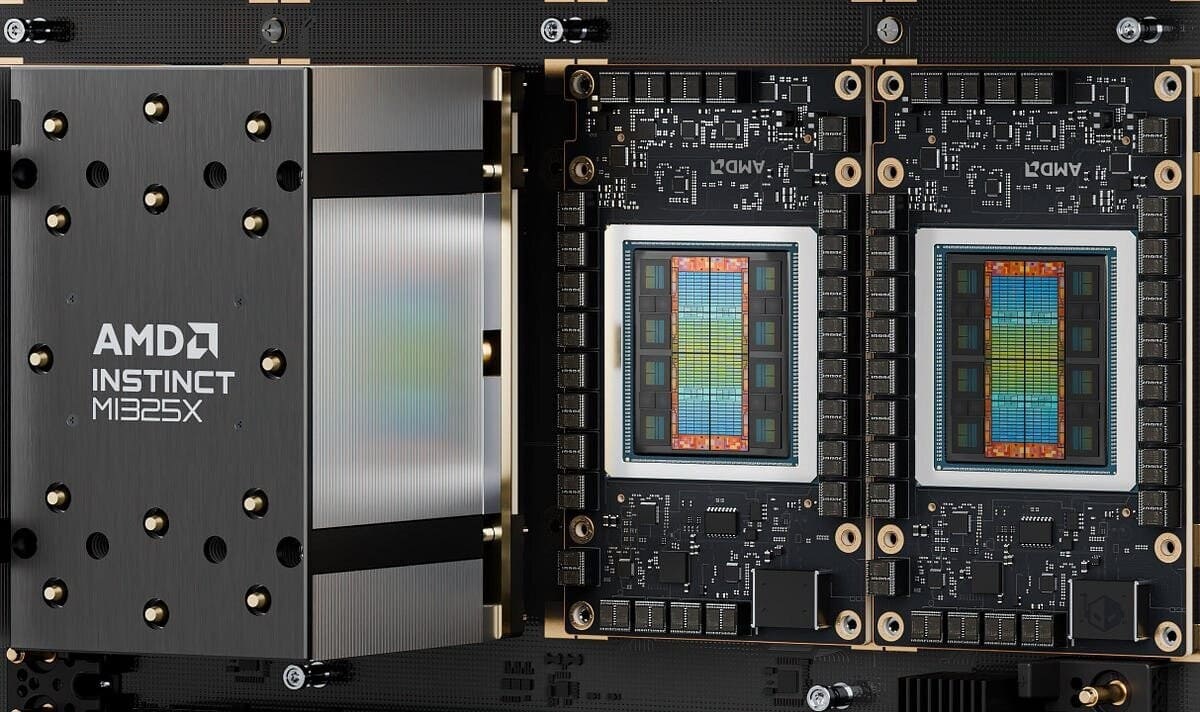

Limitaciones fundamentales del MI325X

Una de las principales limitaciones del MI325X es su capacidad de escalado de ocho GPUs, una cifra considerablemente baja en comparación con la capacidad de NVIDIA para gestionar hasta 72 GPUs en un solo clúster con su GB200 NVL72. Esta diferencia resulta clave cuando se trata de inferencia de IA a gran escala y razonamiento en el borde. Para estas aplicaciones, la arquitectura de NVIDIA sigue dominando tanto en rendimiento bruto como en eficiencia en el costo total de propiedad.

Competencia con las opciones air-cooled de NVIDIA

AMD posicionó el MI325X contra los módulos air-cooled HGX B200 NVL8 y HGX B300 NVL16 de NVIDIA, que también están destinados a no operar en entornos de rack a gran escala. Sin embargo, incluso en este segmento, NVIDIA sigue manteniendo la delantera en términos de rendimiento y coste por unidad, lo que ha dificultado el despegue del MI325X.

Oportunidades en implementaciones a menor escala

A pesar de las dificultades, el MI325X mantiene un nicho potencial en implementaciones a menor escala, donde no se requiere una infraestructura de clústeres de GPU extensivos. Para inferencias de modelos más pequeños, el rendimiento de un clúster de ocho GPUs es suficiente, siempre y cuando haya gran capacidad de memoria y ancho de banda.

AMD sigue mejorando su ecosistema de software y manteniendo precios competitivos, lo que podría hacer que el MI325X sea atractivo para laboratorios de IA que desarrollen modelos medianos, que busquen una opción con un bajo coste total de propiedad.

Vía: TechPowerUp